Robbanás! DeepSeeka kínai újévi ajándék - a multimodális modell részletes magyarázata Janus-Pro

A DeepSeek legújabb Janus-Pro modellje közvetlenül összekapcsolja a multimodális mesterséges intelligencia "bal és jobb agyféltekéjét"!

Ez a kétarcú gyilkos, amely egyszerre képes kép- és szövegértésre és képgenerálásra, saját fejlesztésű keretrendszerével újraírja az iparág szabályait.

Ez nem a funkciók egyszerű szuperpozíciója, hanem a vizuális kódolási útvonal szétválasztásával a modell elérte a valódi "egy elme, két használat" elvét.

A hagyományos multimodális modellek olyanok, mintha ugyanazt a kezet használnánk írásra és rajzolásra, míg az Janus-Pro közvetlenül két neurális rendszerrel szereli fel a mesterséges intelligenciát!

Keretforradalom: a multimodalitás évszázados problémájának megoldása

Az Janus-Pro legkíméletlenebb újítása a vizuális kódolás két független csatornára való felosztása.

Ez olyan, mintha a mesterséges intelligenciát a megértés szemével és az alkotás kezével szerelnénk fel, hogy a modell többé ne küzdjön a "képleírás" és a "szövegből kép" feldolgozása során.

A legnagyobb áttörést a vadonatúj, egységes architektúra kialakítása jelenti. Ez az architektúra három alapvető komponensből áll:

Autoencoder: mint az alapvető nyelvi modell

SigLIP-L@384: felelős a képi megértés kódolásáért

VQ-VAE a LlamaGen alapján: képgeneráláshoz

A vizuális kódolás független útvonalakra történő szétválasztásával, ugyanakkor az egységes transzformátor-architektúra fenntartásával az Janus-Pro zseniálisan oldja fel a korábbi modellek szerepkonfliktusát a vizuális kódolóban.

@reach_vb rámutat a legfontosabb áttörésre az architektúrában:

A modell a DeepSeek-LLM-1.5b/7b-re épül, SigLIP-L-t használ a 384×384 képméretű bemenetek feldolgozásához, és a kódolási folyamatot feladatspecifikus útvonalakon keresztül szétválasztja.

Ez a kialakítás lehetővé teszi, hogy a modell zökkenőmentesen váltson a multimodális feladatok között, miközben egyetlen Transformer architektúrát tart fenn.

Képzési stratégia: az evolúciós út a háromlépcsős sikerhez

A DeepSeek csapata egy gondosan megtervezett, háromlépcsős képzési folyamatot alkalmazott:

1. szakasz: Új paraméterek képzése az ImageNet-adatkészleten a vizuális és nyelvi elemek közötti fogalmi kapcsolatok létrehozása érdekében.

2. szakasz: Multimodális hibrid adathalmaz bevezetése a teljes paraméter-finomhangoláshoz

3. szakasz: A parancskövetési és párbeszédképesség javítása felügyelt finomhangolással

Innovatív kiigazításokat végeztek az adatok arányában is:

Képmegértési feladat: 50% (jelentős növekedés)

Képgenerálási feladat: 40

Szöveges feladat: 10%

@iScienceLuvr rámutat az edzés titkára:

A szöveges feladatok arányát szándékosan csökkentették a finomhangolás harmadik szakaszában.

Ez arra kényszeríti a modellt, hogy a számítási teljesítményét az intermodális konverzióra összpontosítsa.

Teljesítmény mester

Ez a "mindenes" szörnyeteg a két legfontosabb mérőszámban gyilkol!

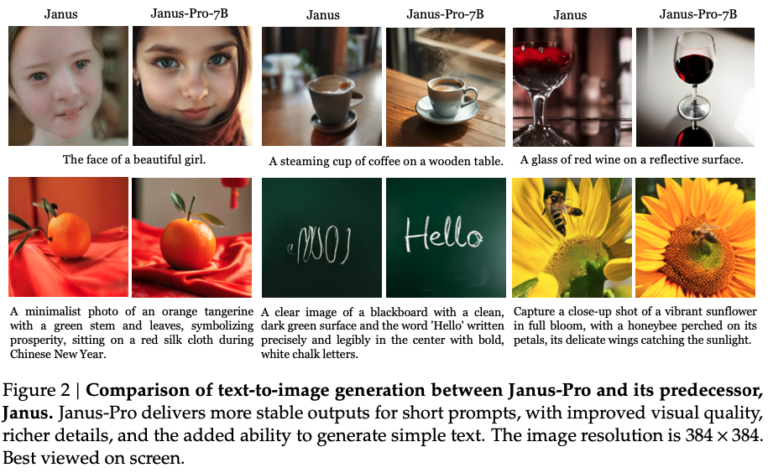

A hivatalos tesztek azt mutatják, hogy az Janus-Pro nem csak az előző egységesített modellt veri, de még a speciális modellekkel is felveszi a versenyt - a szövegértési feladatban olyan magas pontszámot ért el, mint az LLaVA, és a generációs minőségben felülmúlja a DALL-E 3-at!

0,8-as GenEval pontszámával az SD3-Mediumot is megszégyeníti.

és 84,19-es DPG-Bench pontszámával a vizuális alkotás minősége közel áll a professzionális tervezőkéhez.

Ennek alapja egy 72 millió szintetikus képet tartalmazó képzési stratégia és három képzési szakasz (adapteres képzés → egységesített előképzés → felügyelt finomhangolás), amely a modellt szó szerint "multimodális mesterré" tette.

@dr_cintas közzétette a tényleges mérések összehasonlítását:

A 4 bites kvantált változatot egy iPhone-on futtatva a következtetés sebessége közel 60 token/s.

A generált 384×384-es miniatűr képen ténylegesen olvasható a rendszámtábla szövege

A multimodális megértési benchmark tesztben az Janus-Pro-7B elképesztően erősnek bizonyult:

PÁPA: 87.4%

MME-PT: 1567.1

MMBench: 79.2

SEED: 72.1

MMMU: 41.0

MM-Vet: 50.0

A képalkotás tekintetében a modell 0,8-as GenEval-pontszámot és 84,19-es DPG-Bench-pontszámot ért el, ami számos mainstream modellt, köztük a DALL-E 3-at és az SD3-Mediumot is felülmúlja.

MIT nyílt forráskód: játszhatsz bátran!

A DeepSeek ezúttal fordított a kockán - a 7B/1B kettős verzió teljesen nyílt forráskódú, és a MIT licenc lehetővé teszi a kereskedelmi módosításokat!

Az Hugging Face azonnal letölthető, és még az 1B lightweight verzió is futtatható helyben egy iPhone-on.

A fejlesztő @angrypenguinPNG élő bemutatót tartott:

Adja be a "future city night scene" kifejezést, és másodpercek alatt megjelent egy cyberpunk utcakép.

Közelítsen rá a jelenet részleteinek vizsgálatához, és a modell pontosan le tudja írni a neonfények gradiensét.

Gyakorlati érték: a belépési korlátok csökkentése

A különböző forgatókönyvek igényeinek kielégítésére a DeepSeek két változatot kínál:

Janus-Pro-7B: a teljes verzió, erőteljes teljesítménnyel

Janus-Pro-1B: egy könnyített verzió, amely közvetlenül a böngészőben futtatható.

Mindkét verzió nyílt forráskódú a Hugging Face platformon, és MIT licenc alatt került kiadásra, így a fejlesztők szabadon használhatják és módosíthatják őket.

A DeepSeek átfogó áttörése

Most a legizgalmasabb kérdés: amikor a megértéshez és a generáláshoz már nem lesz szükség két külön modellre, a meglévő AI-alkalmazási architektúra kollektívan felbomlik-e?

Azoknak, akik még mindig küzdenek az egy-modális alkalmazásokkal, érdemes megfontolniuk, hogy együttműködő alkalmazásokat fejlesszenek ki a bal és a jobb agyfélteke számára.

Végül is egy olyan modell, amely egyszerre képes játszani a szöveggel és a grafikával, a multimodalitás igazi megtestesítője.

Érdemes megjegyezni, hogy az Janus-Pro kiadása csak egy a DeepSeek közelmúltbeli jelentős áttöréseinek sorában:

A Perplexity integrálta a DeepSeek R1 modellt a mély webes kereséshez

A DeepSeek R1 desztillált verziója 60 token/s lokális következtetési sebességet ér el az iPhone-on.

A DeepSeek AI Assistant az App Store ingyenes listájának élére ugrott

és rendkívül gyors következtetési teljesítményt mutatott a Groq platformon.

Ezek az eredmények a DeepSeek átfogó erejét bizonyítják a mesterséges intelligencia területén, és az Janus-Pro úttörő előrelépése új irányokat nyitott a multimodális mesterséges intelligencia fejlesztése előtt.

Janus pro Kapcsolódó linkek és dokumentumok

A projekt címe:

Modell letöltések:

Gyors tapasztalat:

Nincs telepítés, ingyenes, online használat janus pro

Referenciadokumentáció:

Végezetül szeretnénk elmondani: Sam Altman cégnevét, az általa megfestett tortát és az általa végiggondolt utat úgy tűnik, hogy átadja ennek a kíváncsiságtól vezérelt kínai cégnek, amely folytatja az intelligencia határainak mélyreható feltárását!