Das kostengünstige und leistungsstarke Open-Source-Modell von deepseek hat sich wie ein Virus verbreitet. Zahlreiche neue Nutzer haben sich auf der deepseek-Website registriert, was immer wieder zum Absturz der Website führte.

Mit der rasanten Entwicklung der Technologie der künstlichen Intelligenz verändern große Sprachmodelle (LLMs) jeden Aspekt unserer Arbeit und unseres Lebens.

Aber es hat auch viele Schwierigkeiten und Herausforderungen in der letzten Zeit erlebt. Und in diesem Bereich sticht DeepSeek mit seiner innovativen Technologie und hervorragenden Leistung hervor.

Wir werden einen tiefen Einblick in Janus Pro DeepSeek, das neueste KI-Modell und DeepSeeks neuestes multimodales Großmodell auf Open-Source-Basis, nehmen. Erfahren Sie mehr über die technischen Merkmale, die Entwicklungsgeschichte und den praktischen Anwendungswert.

Was ist Janus Pro DeepSeek?

Janus Pro ist ein vom DeepSeek-Team veröffentlichtes Open-Source-Modell für multimodale KI, das hauptsächlich für das Verstehen von Bildern und die Bilderzeugung verwendet wird.

Kernfunktionen

- Multimodales Verstehen und Generieren: Janus Pro kann sowohl Text als auch Bilder gleichzeitig verarbeiten, indem es sowohl den Inhalt des Bildes versteht als auch Bilder auf der Grundlage der Textbeschreibung erzeugt.

- Offene Quelle und groß angelegtes Modell: Es ist in zwei Parametergrößen erhältlich, 1B und 7B, und ist Open Source und im Handel erhältlich

Entwicklung von Janus Pro DeepSeek

Gründung und Entwicklung

- Juli 2023: DeepSeek ist ein offiziell gegründetes Unternehmen mit Hauptsitz in Hangzhou, das sich auf Forschung und Entwicklung im Bereich der allgemeinen künstlichen Intelligenz (AGI) konzentriert.

- 2. November 2023: Veröffentlichung des ersten quelloffenen Code-Großmodells DeepSeek Coder, das Codegenerierung, Debugging und Datenanalyse in mehreren Programmiersprachen unterstützt.

- 29. November 2023: DeepSeek LLM, ein allgemeines großes Modell mit einer Parameterskala von 67 Milliarden, wird eingeführt, einschließlich Basis- und Chat-Versionen von 7B und 67B.

Technische Durchbrüche und Produktwiederholungen

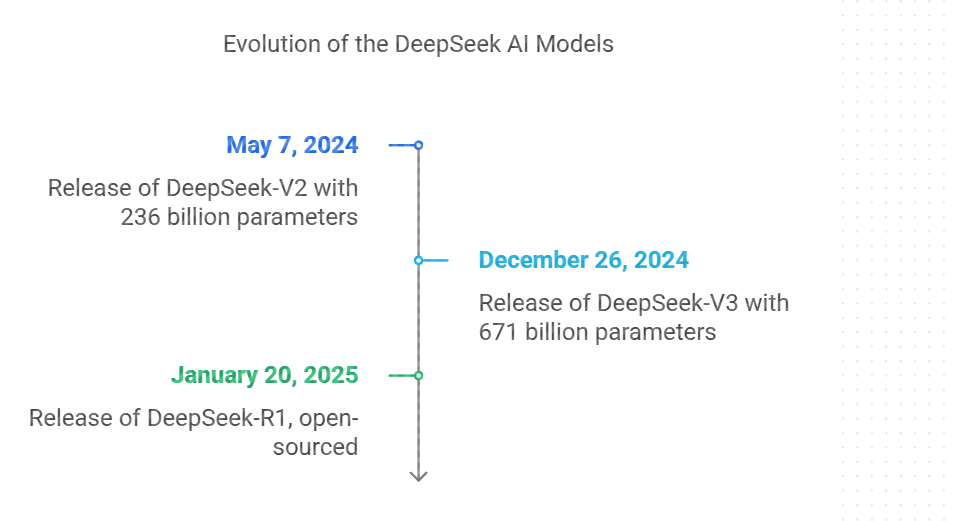

- 7. Mai 2024: DeepSeek-V2, das Open-Source-Hybrid-Expertenmodell (MoE) der zweiten Generation, wird mit insgesamt 236 Milliarden Parametern und auf nur 1 RMB pro Million Token reduzierten Inferenzkosten veröffentlicht.

- 26. Dezember 2024: DeepSeek-V3 wird veröffentlicht, mit insgesamt 671 Milliarden Parametern. Es verwendet eine innovative MoE-Architektur und FP8-Training mit gemischter Präzision, und die Trainingskosten betragen nur 5,576 Millionen US-Dollar.

- Januar 20, 2025: DeepSeek-R1, eine neue Generation von Inferenzmodellen, wird veröffentlicht, mit einer Leistung, die der offiziellen Version o1 von OpenAI gleichkommt, und ist als Open Source verfügbar.

Am 27. Januar hat die janus pro multimodales Modell wurde veröffentlicht und unmittelbar nach der Veröffentlichung als Open Source zur Verfügung gestellt, damit mehr Menschen am Entwicklungsprozess großer KI-Modelle teilnehmen und die neueste KI-Technologie mit begrenzten Ressourcen nutzen und erlernen können.

Janus Pro Die Kerntechnologie von DeepSeek

Entkopplung der visuellen Kodierung

Janus Pro nutzt die Technologie der visuellen Kodierung zur Entkopplung, um den visuellen Kodierungspfad in unabhängige Verarbeitungspfade aufzuteilen, die jeweils für multimodale Verstehens- und Generierungsaufgaben verwendet werden. Dieses Design löst effektiv das Problem des Funktionskonflikts zwischen dem visuellen Kodierer in den Verstehens- und Erzeugungsaufgaben in traditionellen multimodalen Modellen und verbessert die Flexibilität und Aufgabenanpassung des Modells.

Vereinheitlichte Transformator-Architektur

Trotz der Entkopplung des visuellen Kodierungspfads verwendet Janus Pro weiterhin eine einzige Transformer-Architektur zur Bearbeitung multimodaler Aufgaben. Diese einheitliche Architektur vereinfacht das Modelldesign und verbessert gleichzeitig die Skalierbarkeit des Modells und die Fähigkeit der Modelle, aufgabenübergreifend zusammenzuarbeiten.

Optimierte Ausbildungsstrategie

Janus Pro hat eine Reihe von Optimierungen an der Trainingsstrategie vorgenommen, darunter

- Verlängerung der Trainingszeit des ImageNet-Datensatzes, um die Fähigkeiten des Modells zum Bildverständnis zu verbessern.

- Durch das Training von Text-zu-Bild-Daten wird die generative Fähigkeit des Modells optimiert.

- Die Anpassung des Anteils der Trainingsdaten sorgt für eine stabilere und effizientere Leistung des Modells bei multimodalen Aufgaben.

Erweiterte Trainingsdaten

Janus Pro verwendet umfangreiche und vielfältige Trainingsdaten, einschließlich multimodaler Verständnisdaten und visueller Generierungsdaten. Die Erweiterung dieser Daten verbessert nicht nur die Verständnisfähigkeit des Modells, sondern erhöht auch seine generative Qualität.

Innovativer visueller Encoder

Für multimodale Verständnisaufgaben verwendet Janus Pro SigLIP-L als visuellen Encoder, der Bildeingaben mit einer Auflösung von bis zu 384×384 unterstützt. Diese hohe Auflösung ermöglicht es dem Modell, mehr Bilddetails zu erfassen und dadurch die Genauigkeit des visuellen Verständnisses zu verbessern.

Leistungsstarkes generatives Modul

Für Bilderzeugungsaufgaben verwendet Janus Pro den LlamaGen Tokenizer mit einer Downsampling-Rate von 16, um detailliertere Bilder zu erzeugen. Dieses Design macht die erzeugten Bilder realistischer und detaillierter.

Infrastruktur-Innovationen

Janus Pro basiert auf den Modellen DeepSeek-LLM-1.5b und DeepSeek-LLM-7b, die das Modell mit leistungsstarken multimodalen Verarbeitungsfähigkeiten ausstatten, wodurch es sich bei multimodalen Verständnis- und Generierungsaufgaben auszeichnet.

Multimodale Verständnis- und Generierungsfähigkeiten

Janus Pro ist nicht nur in der Lage, multimodale Verstehensaufgaben zu bewältigen (z. B. die Beantwortung visueller Fragen und die Beschriftung von Bildern), sondern auch qualitativ hochwertige Bilder aus Textbeschreibungen zu erzeugen. Diese Fähigkeit zeichnet es in multimodalen Szenarien aus.

Janus Pro DeepSeek-Leistung

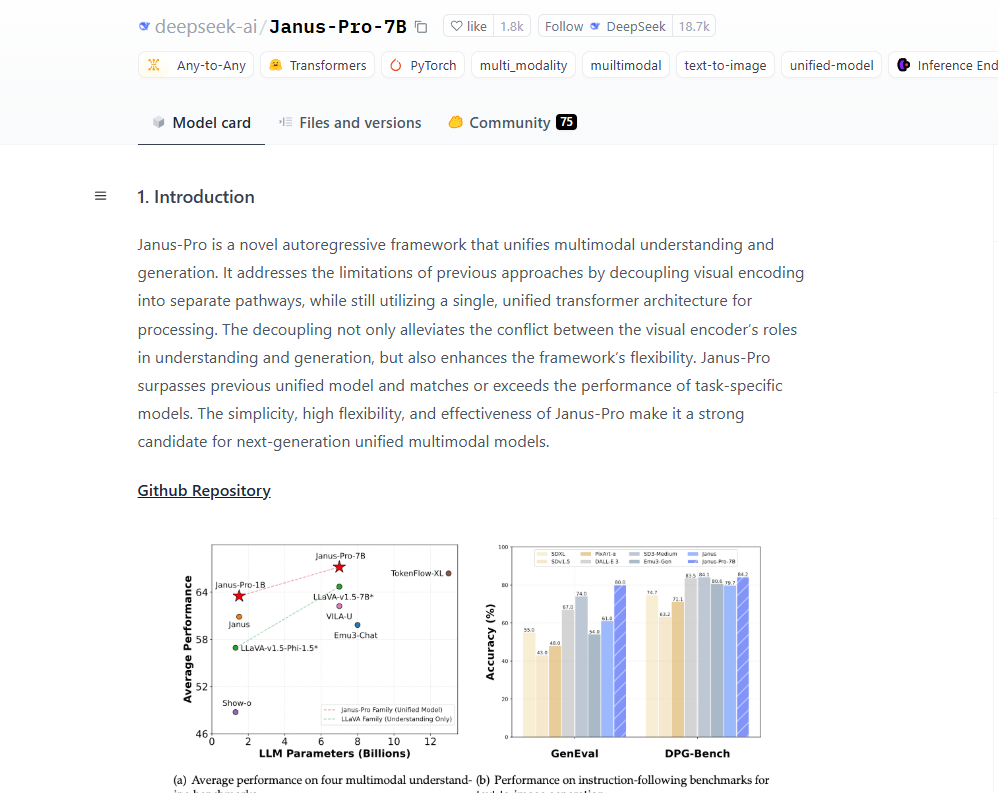

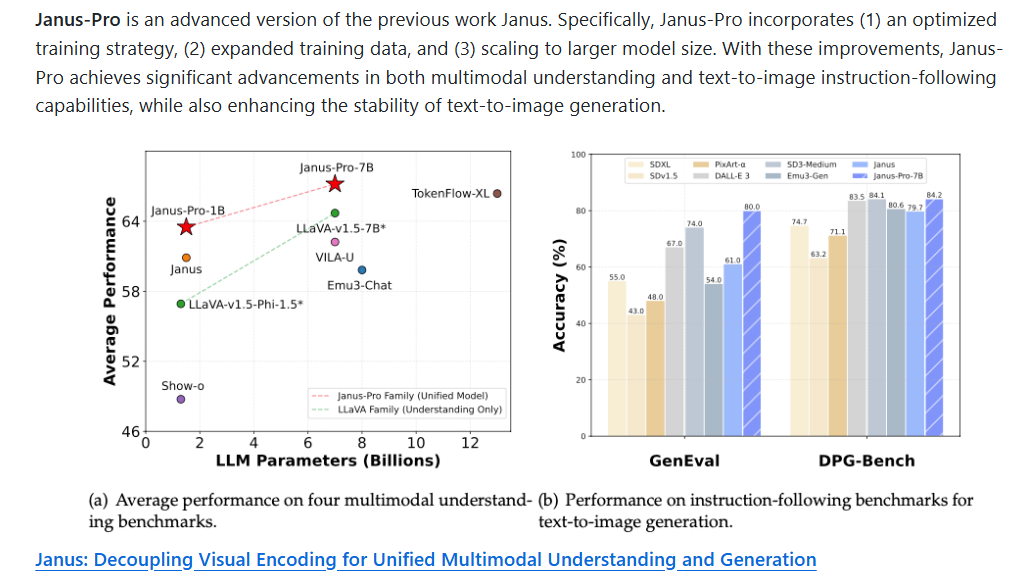

Das Janus-Pro-Modell von DeepSeek zeichnet sich bei multimodalen Verständnis- und Generierungsaufgaben aus. Es folgt eine detaillierte Analyse seiner Leistung:

Multimodale Verstehensleistung

- MMBench-Benchmark: Janus-Pro-7B erreichte im MMBench-Benchmark für multimodales Verstehen eine Punktzahl von 79,2 und übertraf damit die bestehenden, auf dem neuesten Stand der Technik befindlichen vereinheitlichten multimodalen Modelle wie Janus (69,4), TokenFlow (68,9) und MetaMorph (75,2).

- Beantwortung visueller Fragen: Die Genauigkeit des Janus-Pro bei der Beantwortung visueller Fragen übertrifft die des GPT-4V, indem es Details in Bildern genau identifiziert und entsprechende Fragen beantwortet.

Text-zu-Bild-Befehlsverfolgung

- GenEval-Benchmark-Test: Janus-Pro-7B erreichte im GenEval-Test eine Gesamtgenauigkeit von 80% und übertraf damit andere Modelle wie DALL-E 3 (67%) und Stable Diffusion 3 Medium (74%) deutlich.

Komplexe Befehle verstehen: Im DPG-Bench-Test erzielte der Janus-Pro-7B hervorragende 84,19 Punkte und war in der Lage, komplexe Szenen wie "einen schneebedeckten Berg mit einem blauen See an der Spitze" korrekt zu erzeugen.

Leistung der Text-zu-Bild-Generierung

- Bildqualität und Stabilität: Trotz einer Ausgabeauflösung von 384×384 weisen die vom Janus-Pro-7B erzeugten Bilder einen hohen Grad an Realismus und Detailreichtum auf, insbesondere bei der Verarbeitung fantasievoller und kreativer Szenen. Es kann die semantischen Informationen in den eingegebenen Wörtern genau verstehen und logisch sinnvolle und kohärente Bilder erzeugen.

- Erzeugungsgeschwindigkeit: Janus-Pro unterstützt die Erzeugung von 4K-Bildern auf einer einzigen Karte, was 2 Mal schneller ist als Stable Diffusion 3.

Modellarchitektur und Schulung

- Entkopplung der visuellen Kodierung: Janus-Pro verwendet eine unabhängige Kodierungsmethode, um die ursprüngliche Eingabe in Merkmale umzuwandeln, die dann von einem vereinheitlichten autoregressiven Transformator verarbeitet werden, um die Entkopplung der visuellen Kodierung bei multimodalen Verstehens- und Generierungsaufgaben zu erreichen.

- Trainingsdaten: Janus-Pro bezieht 72 Millionen hochwertige synthetische Bilder in das Training ein, um ein 1:1-Verhältnis von realen zu synthetischen Daten zu gewährleisten. Darüber hinaus werden etwa 90 Millionen Samples multimodaler Verständnis-Trainingsdaten hinzugefügt, was die Modellleistung erheblich verbessert.

Skalierbarkeit und Einsatz

Modellgröße: Die Janus-Pro-Serie bietet Modelle mit den Parametergrößen 1B und 7B, die sowohl die Leistung als auch die Rechenkosten berücksichtigen und für mehr Anwendungsfälle geeignet sind.

Minimaler Einsatz: Janus-Pro wird unter der MIT-Lizenz veröffentlicht, unterstützt die kommerzielle Nutzung und bietet zwei Versionen: 1.5B (erfordert 16 GB VRAM) und 7B (erfordert 24 GB VRAM), die auf Standard-GPUs laufen können.

Praktische Anwendungsszenarien von Janus Pro DeepSeek

Multimodale KI-Modelle, insbesondere Text-Bild-Modelle, haben ein großes Entwicklungspotenzial für den kommerziellen Sektor. Nach einer langen Entwicklungszeit haben KI-Text-Bild-Modelle bereits große Fortschritte gemacht

Im häufigsten Szenario der Werbe- oder Plakatgestaltung können Designer oder Benutzer Janus pro verwenden, um eine Textbeschreibung einzugeben und schnell qualitativ hochwertige Plakate zu erstellen. Durch die Iteration von Plakatprototypen können sie Designzeit sparen und die kreative Effizienz verbessern. Dies kann die Effizienz von Designern erheblich steigern, so dass sie ihre Zeit mit wichtigeren Dingen verbringen können

Neben dem traditionellen Plakat- oder Werbedesign kann das ai-Großmodell den Designern auch dabei helfen, Spielszenen, Charaktere und Gegenstände in Echtzeit zu generieren, was die Kosten und den Schwierigkeitsgrad der Entwicklung reduziert und gleichzeitig die visuellen Effekte des Spiels verbessert. Wir glauben, dass das ai-Großmodell auch weiterhin das Potenzial und die Fantasie von Designern freisetzen und interessantere Produkte realisieren kann.

Neben dem Bereich des Designs wird sich das multimodale Modell auch in anderen Bereichen des Lernens, der Bildung und im vertikalen Berufsfeld der Medizin stark entwickeln.

In Zukunft könnten weitere sehr interessante Anwendungen entstehen, die die Effizienz und die Qualität unseres Lebens erheblich verbessern können.

Die Open-Source-Funktionen von Janus-Pro (MIT-Lizenz) und die minimalen Implementierungsmethoden (unterstützt die Ausführung auf Standard-GPUs) senken die Einstiegshürde weiter, so dass es in den oben genannten Bereichen weit verbreitet ist.

Dadurch können sich mehr Nutzer an der Entwicklung beteiligen, so dass mehr Menschen diese Funktionen verbessern und die Möglichkeiten der gesamten Gemeinschaft erweitern können.

Wie wähle ich die richtige Version von Janus Pro DeepSeek für mich aus?

Janus-Pro ist in zwei Versionen verfügbar: Janus-Pro-1B und Janus-Pro-7B. Für welche Version Sie sich entscheiden, hängt von Ihren spezifischen Bedürfnissen, Computerressourcen und Anwendungsszenarien ab. Im Folgenden finden Sie einen detaillierten Vergleich und Empfehlungen:

Anwendbare Szenarien

Janus-Pro-1B:

- Leichtgewichtige Anwendungen: geeignet für den Einsatz auf mobilen Geräten, in Browsern oder in Umgebungen mit eingeschränkten Ressourcen. So können mehr Nutzer das neueste Janus pro erleben.

- Schnelles Prototyping: geeignet für die schnelle Entwicklung und Prüfung multimodaler Funktionen, ohne dass große Rechenressourcen erforderlich sind. Dies ist sehr wichtig für KI-Enthusiasten, die schnell iterieren und Probleme, die in der Forschung aufgetreten sind, entdecken können, ohne dass sie viele Computerressourcen benötigen.

Janus-Pro-7B:

- Hochwertige Bilderzeugung: Geeignet für Anwendungen, die die Erzeugung hochwertiger Bilder von komplexen Szenen erfordern, wie z. B. Werbedesign, Spieleentwicklung und künstlerische Gestaltung. Dieses Modell eignet sich besser für professionellere Design-Szenarien, die leistungsfähigere Hardware und mehr Rechenleistung erfordern.

- Komplexes Anweisungsverständnis: geeignet für Szenarien, in denen komplexe Textanweisungen verarbeitet und präzise Bilder erzeugt werden müssen, z. B. in der virtuellen Realität (VR) und der erweiterten Realität (AR)

Anforderungen für den Einsatz

Janus-Pro-1B:

- Hardware-Anforderungen: Geeignet für die Ausführung auf ressourcenbeschränkten Geräten, wie z. B. GPUs, die 16 GB VRAM benötigen. Wenn Sie nur eine ältere Grafikkarte haben, ist dies möglicherweise besser für Sie geeignet

- Anwendungsszenario: geeignet für die Ausführung im Browser oder die Bereitstellung auf leichten Geräten.

Janus-Pro-7B:

- Hardware-Anforderungen: Erfordert höhere Rechenressourcen, z. B. einen Grafikprozessor mit 24 GB VRAM. Dies ist eher für Benutzer mit neueren Grafikkarten geeignet.

- Anwendungsszenario: geeignet für die Ausführung auf Standard-GPUs und für Szenarien, die eine hohe Leistung erfordern.

Zusammenfassung

Wenn Ihr Anwendungsszenario eine hohe Bildqualität und ein komplexes Befehlsverständnis erfordert und Sie über ausreichende Rechenressourcen verfügen, empfehlen wir Janus-Pro-7B.

Wenn Sie eine einfache Bereitstellung benötigen oder nur über begrenzte Computerressourcen verfügen, empfehlen wir Janus-Pro-1B.

Unterstützung und Ressourcen der Gemeinschaft

DeepSeek bietet Entwicklern eine Fülle von Ressourcen und Unterstützung:

- Die offizielle Dokumentation enthält detaillierte Beschreibungen der API-Schnittstelle und technische Leitfäden, einschließlich der Feinabstimmung von Modellen, Anleitungen zur Bereitstellung und anderen Inhalten.

- Die Entwicklergemeinschaft bietet Foren und Diskussionsgruppen, um den Erfahrungsaustausch unter den Entwicklern zu erleichtern. Es finden regelmäßig technische Sitzungen und Hackathons statt.

- Der technische Support bietet professionelle technische Unterstützung bei der Lösung von Problemen, die bei der Nutzung auftreten.