Offene KI dringende Finanzierung

Das Silicon Valley ist einfach zu aufregend, wenn DeepSeek seine Wirkung entfaltet.

Gestern waren OpenAI und Anthropic noch die Vorreiter und versuchten mit allen Mitteln, der Konkurrenz ein Bein zu stellen. Über Nacht sind die Infrastrukturanbieter plötzlich "sehr interessiert" geworden.

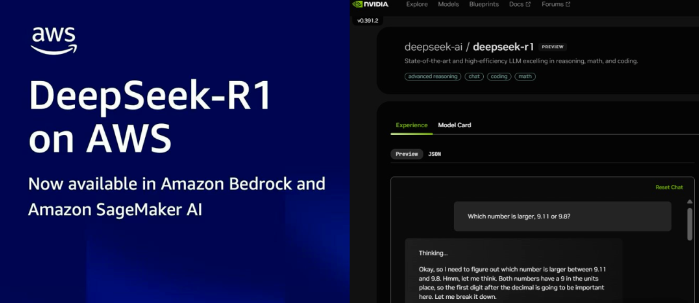

Nach Microsoft haben auch NVIDIA und AWS die Einführung der DeepSeek-Modell-Hosting-Dienste beschleunigt.

Wie ein Nutzer auf dem offiziellen Twitter-Account von NVIDIA kommentierte: "Wenn du sie nicht schlagen kannst, schließe dich ihnen an."

Werfen wir einen Blick auf jeden dieser Schritte.

Zunächst einige neue Nachrichten: Die jüngste Antwort von OpenAI wurde heute bekannt gegeben: Fundraising, Fundraising, Fundraising.

Das Wall Street Journal meldete, dass OpenAI strebt eine neue Finanzierungsrunde in Höhe von $40 Mrd. US-Dollar (ca. 287,5 Mrd. Yuan) bei einer Bewertung von $300 Mrd. US-Dollar an -

was den Rekord für die höchste einzelne Finanzierungsrunde im Silicon Valley brechen würde, der von OpenAI selbst gehalten wird.

Diese Finanzierungsrunde wird von SoftBank angeführt. Frühere Nachrichten deuteten darauf hin, dass SoftBank plant, bis zu $25 Milliarden (etwa 179,7 Milliarden Yuan) in OpenAI investiert.

Und das nur vier Monate nachdem OpenAI $6,6 Milliarden bei einer Bewertung von $157 Milliarden aufgebracht hat.

In nur wenigen Monaten hat sich die Bewertung erneut verdoppelt, was auch die Marktgerüchte bestätigt: OpenAI war mit der letzten Finanzierungsrunde nicht zufrieden.

Und jetzt ist OpenAI vielleicht wirklich ein bisschen verzweifelt:

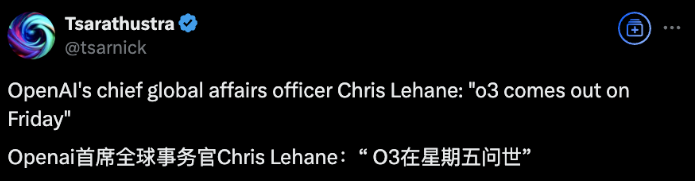

Eine weitere Neuigkeit ist, dass o3 am Freitag (Ortszeit) veröffentlicht werden soll.

Bei den KI-Anwendungen sieht die Sache jedoch etwas anders aus.

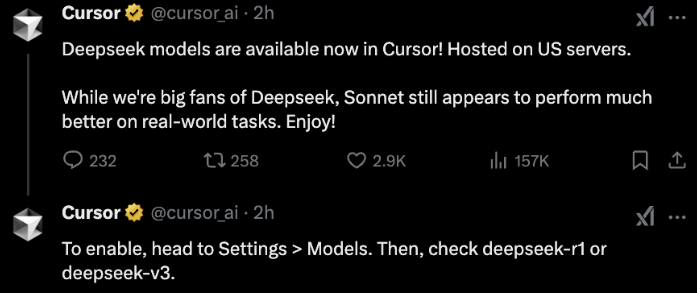

Cursor zum Beispiel, ein Favorit unter den Programmierern, hat das neue Modell bereits offen angenommen und fordert alle auf, es gemeinsam zu testen, um die tatsächlichen Ergebnisse zu sehen.

Nur die Modellanbieter in der Mitte werden im Winde verweht. Bei Cloud-Diensten und -Anwendungen ist es nur richtig, sie alle zuerst zu unterstützen (doge).

Für weitere Einzelheiten lassen Sie uns weiterreden.

Wir sehen uns am Freitag mit Open AI o3

Laut der undichten Stelle ist eines der Ziele von OpenAIs Spendensammlung, sein Versprechen an das Stargate-Projekt zu erfüllen.

Dieses Projekt wird von OpenAI und SoftBank geleitet, mit Arm, Microsoft, NVIDIA und Oracle als wichtigen Technologiepartnern. Ziel ist es, in den nächsten vier Jahren $500 Milliarden (etwa 3,64 Billionen Yuan) in den Aufbau mehrerer KI-Rechenzentren in den USA zu investieren.

Die Verpflichtung von OpenAI lautet: $100 Milliarden.

Die offizielle Ankündigung enthüllt einige Details:

Das Stargate-Projekt ist ein neues Unternehmen, das in den nächsten vier Jahren $500 Milliarden investieren will, um eine neue KI-Infrastruktur für OpenAI in den Vereinigten Staaten aufzubauen. Wir werden sofort $100 Mrd. investieren.

Zu den ersten Kapitalgebern des Projekts gehören SoftBank, OpenAI, Oracle und der KI-Fonds MGX aus dem Nahen Osten. SoftBank und OpenAI sind die federführenden Partner des Projekts, wobei SoftBank für die Finanzen und OpenAI für den Betrieb verantwortlich ist. Masayoshi Son wird als Vorsitzender fungieren.

Arm, Microsoft, NVIDIA, Oracle und OpenAI sind wichtige erste Technologiepartner. Der Bau ist derzeit im Gange, beginnend in Texas, und wir evaluieren potenzielle Standorte im ganzen Land, um weitere Standorte zu errichten, während wir die Vereinbarungen abschließen.

Im Rahmen des Stargate-Projekts werden Oracle, NVIDIA und OpenAI eng zusammenarbeiten, um das Rechensystem zu bauen und zu betreiben. Dies baut auf der intensiven Zusammenarbeit zwischen OpenAI und NVIDIA seit 2016 sowie auf der neuen Zusammenarbeit zwischen OpenAI und Oracle auf.

Sie baut auch auf der bestehenden Beziehung von OpenAI zu Microsoft auf. OpenAI wird seine Nutzung von Azure weiter ausbauen und mit Microsoft zusammenarbeiten, um zusätzliche Rechenleistung für das Training führender Modelle und die Bereitstellung außergewöhnlicher Produkte und Dienstleistungen zu nutzen.

Darüber hinaus wird das Geld von OpenAI auch zur Deckung von Verlusten verwendet werden. Obwohl im August 2024 die monatlichen Einnahmen von OpenAI 300 Millionen US-Dollar erreichten, was einem Anstieg von 1700% im Vergleich zu Anfang 2023 entspricht, wird OpenAI im Oktober voraussichtlich einen Gesamtjahresverlust von 5 Milliarden US-Dollar verzeichnen.

Zusammen mit der Nachricht über die Finanzierung wurde auch der aktuelle Zeitplan für o3 bekannt gegeben.

In einem Interview mit NPR erklärte Chris Lehane, Chief Global Affairs Officer von OpenAI:

o3 wird am Freitag veröffentlicht.

Sobald die Nachricht bekannt wurde, war der Internetnutzer Xiaomaza bereit.

Einige Internetnutzer wiesen jedoch darauf hin, dass er mit "o3" immer noch o3-mini meinte, und Altman selbst hatte die Einführung dieses Modells schon lange angekündigt.

Denn trotz der Kontroverse sorgt DeepSeek für mehr Diskussionen und Lob über den großen Teich

DeepSeek ist wirklich gut

Nachdem Microsoft seine Finger gezeigt hatte, verband es seine KI-Plattform sofort mit dem DeepSeek-Modell. Heute gab auch Cursor, ein Favorit der Programmierer, die neuesten Nachrichten bekannt:

das DeepSeek-Modell ist jetzt auf Cursor verfügbar.

Es ist erwähnenswert, dass Cursor erwähnte, dass der Sonnet 3.5 bei tatsächlichen Programmieraufgaben immer noch besser ist als das neue Modell von DeepSeek.

Die Cursor-Beamten nannten jedoch kein konkretes Beispiel, was die Neugierde der Zuschauer weckte:

Es scheint, dass es an der Zeit ist, mit realen Messungen zu sprechen. Wenn Sie es bereits ausprobiert haben, können Sie uns Ihre Erfahrungen im Kommentarbereich mitteilen.

Auch das Großmaul Anthropic, dessen Geldgeber AWS ebenfalls als erster das DeepSeek-Modell übernommen hat, hat angesichts der Kontroverse nicht gezögert (doge).

Ein weiteres Unternehmen, das mehr Aufmerksamkeit auf sich gezogen hat, ist NVIDIA, dessen Aktienkurs durch DeepSeek- sehr stark angekurbelt wurde.

DeepSeek-R1 ist bereits auf der NVIDIA NIM-Plattform verfügbar. NVIDIA hat auch viel Aufhebens darum gemacht:

DeepSeek-R1 ist ein Open-Source-Modell mit hochmodernen Inferenzfunktionen. Inferenzmodelle wie DeepSeek-R1 geben keine direkten Antworten, sondern führen Inferenzen auf Anfragen durch, um durch Gedankenketten, Konsens und Suchmethoden die beste Antwort zu generieren.

DeepSeek-R1 ist ein perfektes Beispiel für das Skalierungsgesetz beim Testen und beweist, warum beschleunigtes Computing für die Inferenzanforderungen von Proxy AI unerlässlich ist.

NVIDIA sagt, dass DeepSeek-R1 NIM-Microservices 3.872 Token pro Sekunde auf einem einzigen NVIDIA HGX H200 System liefern können.

Und es gibt auch immer mehr Gegenstimmen zu den unfreundlichen Reaktionen von Anthropic und anderen, die mit DeepSeek konkurrieren.

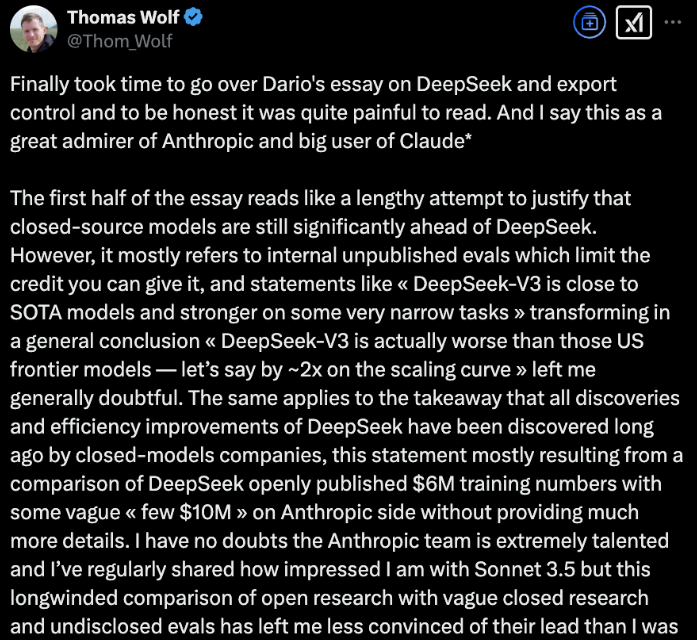

So kritisierte beispielsweise der Mitbegründer von HuggingFace, Thomas Wolf, direkt:

Um ehrlich zu sein, war der Artikel von Dario sehr schmerzhaft zu lesen.

In seinem kurzen Essay schrieb er:

Der Vergleich von Open-Source-Forschung mit vager geschlossener Forschung und unveröffentlichten Bewertungen hat mein Vertrauen in die führende Position von Anthropic verringert.

Noch wichtiger ist, dass mit der Entwicklung von Open-R1 und dem DeepSeek-Papier Teams aus der ganzen Welt in den kommenden Monaten Open-Source-Inferenzmodelle veröffentlichen werden. So haben beispielsweise das Allen Institute und Mistral heute Tülu bzw. Small3 veröffentlicht, um mit DeepSeek-V3 gleichzuziehen.

Open Source wird für unsere Sicherheit immer wichtiger werden.

Was meinen Sie dazu?