Wichtigste Highlights

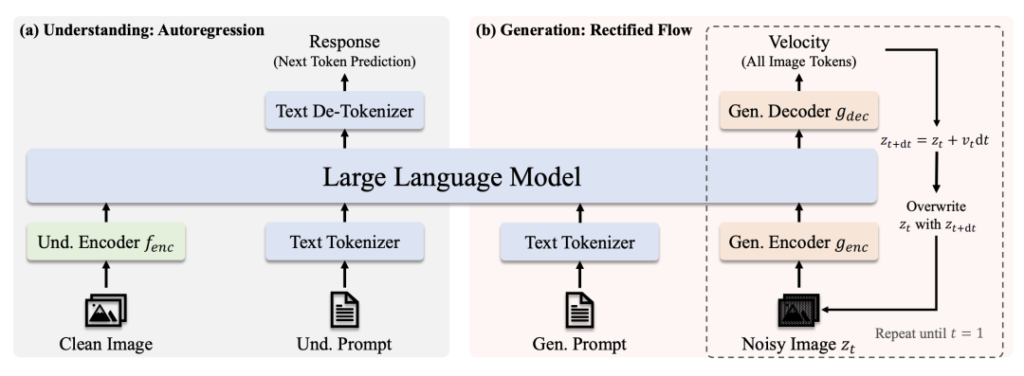

🔹 Vereinheitlichte Transformator-Architektur: Ein einziges Modell ist für das Verstehen beider Bilder zuständig und Generation, wodurch die Notwendigkeit separater Systeme entfällt.

🔹 Skalierbar & Open-Source: Verfügbar in 1B und 7B Parameter-Versionen (MIT-lizensiert), optimiert für verschiedene Anwendungen und kommerzielle Nutzung.

🔹 Leistung auf dem neuesten Stand der Technik: Übertrifft OpenAIs DALL-E 3 und Stable Diffusion in Benchmarks wie GenEval und DPG-Bench.

🔹 Vereinfachte Bereitstellung: Die schlanke Architektur senkt die Kosten für Schulungen und Einweisungen, während die Flexibilität erhalten bleibt.

Modell Links

- Janus-Pro-7B: HuggingFace

- Janus-Pro-1B: HuggingFace

- GitHub: Code & Dokumente

Warum Janus-Pro sich abhebt

1. Zwei Supermächte in einem Modell

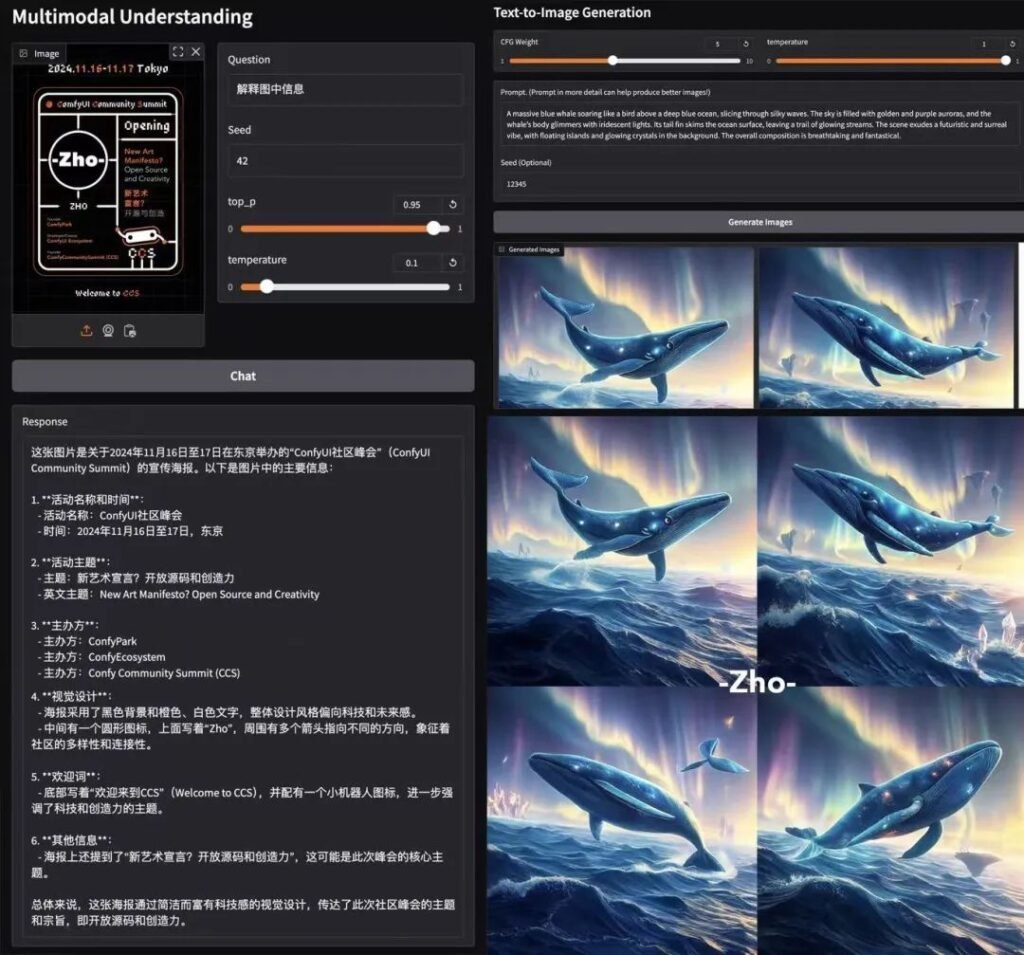

- Modus verstehen: Verwendet SigLIP-L (die "Superbrille") zur Analyse von Bildern (bis zu 384×384) und Text.

- Erzeugungsmodus: Hebelwirkung Rektifizierter Durchfluss + SDXL-VAE (der "magische Pinsel"), um hochwertige Bilder zu erstellen.

2. Gehirnleistung & Training

- Kern-LLM: Basiert auf dem leistungsstarken Sprachmodell von DeepSeek (1,5B/7B Parameter), das sich durch kontextbezogene Schlussfolgerungen auszeichnet.

- Ausbildung Pipeline: Pre-Training auf riesigen Datensätzen → Überwachtes Fine-Tuning → EMA-Optimierung für Spitzenleistung.

3. Warum Transformator-Überdiffusion?

- Vielseitigkeit der Aufgaben: Der Schwerpunkt liegt auf dem einheitlichen Verständnis und der Generierung, während sich Diffusionsmodelle ausschließlich auf die Bildqualität konzentrieren.

- Wirkungsgrad: Autoregressive Generierung (Einzelschritt) vs. iterative Entrauschung durch Diffusion (z.B. 20 Schritte bei stabiler Diffusion).

- Kosten-Wirksamkeit: Ein einziger Transformer-Backbone vereinfacht Schulung und Bereitstellung.

Benchmark-Dominanz

📊 Multimodales Verstehen

Janus-Pro-7B übertrifft spezialisierte Modelle (z. B. LLaVA) bei vier wichtigen Benchmarks und skaliert gleichmäßig mit der Parametergröße.

🎨 Text-zu-Bild-Generierung

- GenEval: Passt zu SDXL und DALL-E 3.

- DPG-Bench: 84.2% Genauigkeit (Janus-Pro-7B) und übertrifft damit alle Wettbewerber.

Realitätsnahe Tests

- Geschwindigkeit: ~15 Sekunden/Bild (L4-GPU, 22 GB VRAM).

- Qualität: Starke prompte Einhaltung, auch wenn kleinere Details verfeinert werden müssen.

- Colab-Demo: Versuchen Sie Janus-Pro-7B (Pro-Stufe erforderlich).

Technische Gliederung

Architektur

- Pfad des Verständnisses: Sauberes Bild → SigLIP-L-Encoder → LLM → Textantwort.

- Generation Pfad: Verrauschtes Bild → Rectified Flow Decoder + LLM → Iterative Rauschunterdrückung.

Wichtige Innovationen

- Entkoppelte visuelle Kodierung: Getrennte Wege zum Verstehen/Erzeugen verhindern "Rollenkonflikte" in Sehmodulen.

- Gemeinsamer Transformatorkern: Ermöglicht einen aufgabenübergreifenden Wissenstransfer (z. B. hilft das Erlernen von "Katzen"-Konzepten sowohl beim Erkennen als auch beim Zeichnen).

Gemeinschaft Buzz

AK (KI-Forscher): "Die Einfachheit und Flexibilität von Janus-Pro machen es zu einem erstklassigen Kandidaten für multimodale Systeme der nächsten Generation. Durch die Entkopplung der Bildverarbeitungspfade bei gleichzeitiger Beibehaltung eines einheitlichen Transformators schafft es ein Gleichgewicht zwischen Spezialisierung und Generalisierung - eine seltene Leistung.

Warum die MIT-Lizenz wichtig ist

- Freiheit: Kommerzielle Nutzung, Änderung und Verbreitung mit minimalen Einschränkungen.

- Transparenz: Vollständiger Code-Zugriff beschleunigt die von der Gemeinschaft betriebenen Verbesserungen.

Endgültige Entscheidung

Janus-Pro von DeepSeek ist nicht nur ein weiteres KI-Modell, sondern ein Paradigmenwechsel. Durch die Vereinheitlichung von Verständnis und Erzeugung unter einem Dach öffnet es die Türen für intelligentere kreative Werkzeuge, Echtzeitanwendungen und kosteneffiziente Implementierungen. Mit Open-Source-Zugang und MIT-Lizenzierung könnte dies der Katalysator für die nächste Welle der multimodalen Innovation sein. 🚀

Für Entwickler: Sehen Sie sich die ComfyUI-Knoten und schließen Sie sich der Experimentierwelle an!

dieser Beitrag wird gesponsert von: