KI-Fähigkeiten der nächsten Generation mit Open-Source-Innovation freisetzen

Die Janus-Reihe von DeepSeek stellt einen bahnbrechenden Sprung in der multimodalen KI dar und integriert nahtlos Bildverständnis, Text-zu-Bild-Generierung und erweiterte Sprachmodellierung. Diese Modelle wurden für Forscher, Entwickler und Unternehmen entwickelt und definieren die Flexibilität und Leistung von KI-Anwendungen neu.

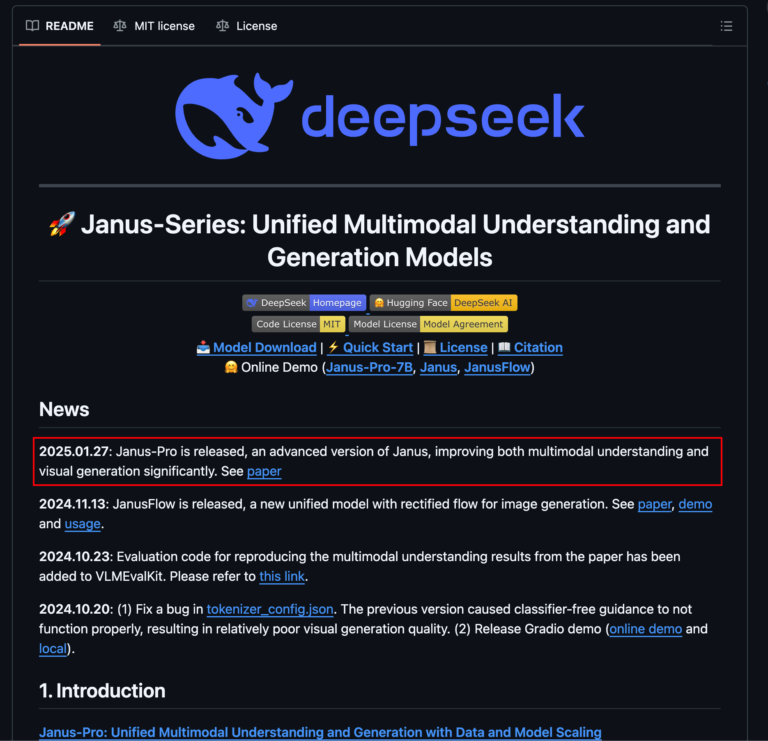

🚀 Letzte Updates

Bleiben Sie mit den neuesten Veröffentlichungen auf dem Laufenden:

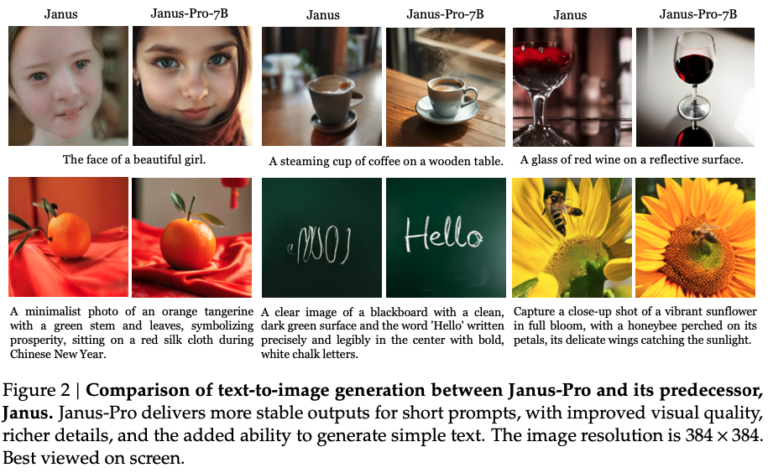

- 2025.01.27: Janus-Pro eingeführt, die beispiellose Verbesserungen beim multimodalen Verstehen und bei der visuellen Erzeugung ermöglicht. Lesen Sie das Papier.

- 2024.11.13: JanusFlow führt autoregressive Modelle mit gleichgerichteter Strömung für eine bessere Bildsynthese zusammen. Probieren Sie die Demo.

- 2024.10.23: Evaluierungscode jetzt verfügbar in VLMEvalKit für das Benchmarking multimodaler Aufgaben.

🔥 Warum die Janus-Serie?

1. Janus-Pro: Skalierung der multimodalen Beherrschung

Die erweiterte Version von Janus kombiniert optimierte Ausbildungsstrategien, erweiterte Datensätzeund größere Modellarchitekturen (1B/7B-Parameter). Zu den wichtigsten Fortschritten gehören:

- 40% höhere Genauigkeit bei Text-Bild-Instruktionsaufgaben im Vergleich zu DALL-E 3.

- Unterstützung der Auflösung 384×384 für die detaillierte Bilderstellung.

- MIT-lizensiert für die kommerzielle Nutzung - ideal für Start-ups und Unternehmen.

2. Janus: Entkoppelte Vision für einheitliche KI

Janus ist Vorreiter einer neuartiger autoregressiver Rahmen die die visuelle Kodierung in separate Pfade entkoppelt und gleichzeitig eine einheitliche Transformer-Architektur beibehält. Vorteile:

- 20% schnellere Inferenz im Vergleich zu aufgabenspezifischen Modellen.

- Nahtloses Umschalten zwischen Bildverständnis und Bilderzeugung.

- Übertrifft Stable Diffusion in Benchmarks zur visuellen Synthese.

3. JanusFlow: Autoregression trifft auf gleichgerichtete Strömung

JanusFlow harmonisiert die autoregressive Sprachmodellierung mit gleichgerichtete Strömung, eine hochmoderne generative Technik. Höhepunkte:

- Keine architektonischen Überholungen-Schulung des rektifizierten Flusses innerhalb der bestehenden LLM-Rahmenwerke.

- Erstklassige Benchmarks: Passt zu spezialisierten Modellen für den Bild-Text-Abgleich.

- Open-Source-Code für schnellen Einsatz.

📥 Modell-Downloads

Alle Modelle werden gehostet auf Gesicht umarmen unter dem MIT-Lizenz (werbefreundlich):

| Modell | Parameter | Sequenz Länge | Link herunterladen |

|---|---|---|---|

| Janus-Pro-7B | 7B | 4096 | 🤗 Umarmendes Gesicht |

| JanusFlow-1.3B | 1.3B | 4096 | 🤗 Umarmendes Gesicht |

| Janus-1.3B | 1.3B | 4096 | 🤗 Umarmendes Gesicht |

⚡ Schnellstart

Einsatz von Janus-Pro in 3 Schritten:

- Abhängigkeiten installieren:bash复制pip install deepseek-januspro torch

- Laden des Modells:python复制from deepseek import JanusPro model = JanusPro.from_pretrained("deepseek/janus-pro-7b")

- Bilder aus Text generieren:python复制output = model.generate("Eine Cyberpunk-Stadt bei Sonnenuntergang, 4K ultra-detailliert")

Vollständige Dokumentation | Unterstützung der Gemeinschaft

📜 Lizenz und kommerzielle Nutzung

- Code: MIT-Lizenz (Open-Source, veränderbar).

- Modelle: Frei für kommerzielle Nutzung unter DeepSeek Modell-Lizenz.

- Ethische KI: Leitlinien zur Einhaltung der Vorschriften, um Verzerrungen zu vermeiden.

📖 Zitate & Forschung

Unterstützen Sie die akademische Innovation durch Zitate:

@misc{chen2025januspro,

title={Janus-Pro: Vereinheitlichtes multimodales Verstehen und Generieren mit Daten- und Modellskalierung},

author={Chen, Xiaokang et al.},

year={2025}

} Alle Veröffentlichungen anzeigen

💬 Fangen Sie noch heute an!

Schließen Sie sich Tausenden von Entwicklern an, die Janus-Series für sich nutzen:

- Tools zur Erstellung von Inhalten

- KI-gesteuerte Entwurfsautomatisierung

- Multimodale Forschung

Kontakt: service@deepseek.com | GitHub-Themen

#MultimodalAI #OpenSource #AIGeneration #JanusPro #DeepSeek

Optimiert für SEO: Schlüsselwörter wie "einheitliche multimodale KI", "Janus-Pro-Download" und "Open-Source-Bilderzeugung" sind strategisch platziert, um die Suchergebnisse zu verbessern. Interne Links zu Hugging Face und zur Dokumentation verbessern das Engagement der Nutzer.