DeepSeek R1,是由中國人工智能公司 DeepSeek 開發的一種新的開源 AI 語言模型,目前很受歡迎。

有些使用者聲稱,就推理能力而言,它與 OpenAI 的 o1 不相伯仲,甚至更強。

目前,DeepSeek 是免費的,這對使用者來說是個好消息,但也帶來了一些問題。

隨著使用者數量的增加,他們將如何處理伺服器的成本?運行模型的硬體應該不便宜吧?

一個合理的猜測是資料。

資料是 AI 模型的命脈。它們可能會以某種方式收集使用者資料,這些資料可能對其交易模型或其他形式的貨幣化有用。

如果您擔心資料隱私,但仍想在不共用資料的情況下使用 R1,最好的選擇是在本機執行模型。

什麼是 DeepSeek R1?

幾天前,DeepSeek R1 以完全開放原始碼的模式面世。這表示任何人都可以存取其基本程式碼、進行修改,甚至微調以符合自己的需求。

DeepSeek R1 (通常簡稱為 R1)源自於一個稱為 DeepSeek-V3 的大型基礎模型。

研究團隊結合監督微調 (SFT)、高品質人工註解資料和強化學習 (RL) 來優化這個模型。

這使得聊天機器人可以處理複雜的提示、顯示複雜問題背後的理由(有時比其他模型更清楚),甚至可以在聊天介面中顯示程式碼以進行快速測試。

這真的令人印象深刻,尤其是對於開放原始碼模式而言。

如何在本機執行 DeepSeek R1

至 在本機執行 DeepSeek R1, 我們會使用一個叫做 Ollama 的工具。

Ollama 是一個免費的開放原始碼工具,可讓使用者在本機電腦上執行大型語言模型 (LLM)。

它適用於 macOS、Linux 和 Windows。請造訪 Ollama 官方網站,按一下「下載」按鈕,然後安裝到您的系統上。

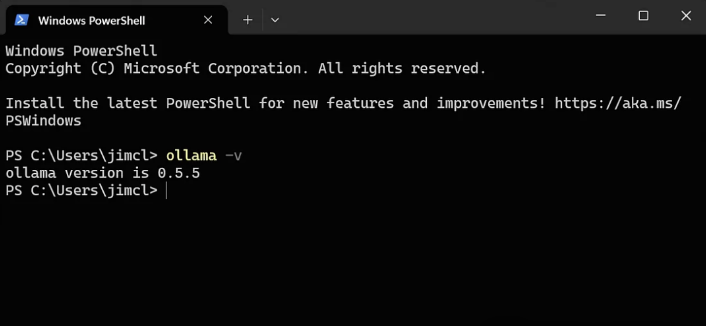

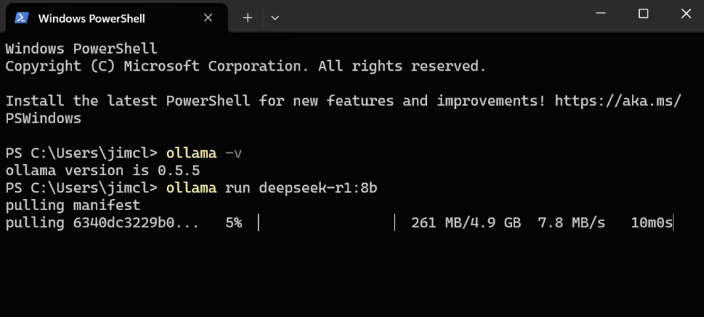

要確認安裝成功、

開啟終端機並執行下列指令:olama -v

您應該會看到 Ollama 版本編號,而不是錯誤訊息。

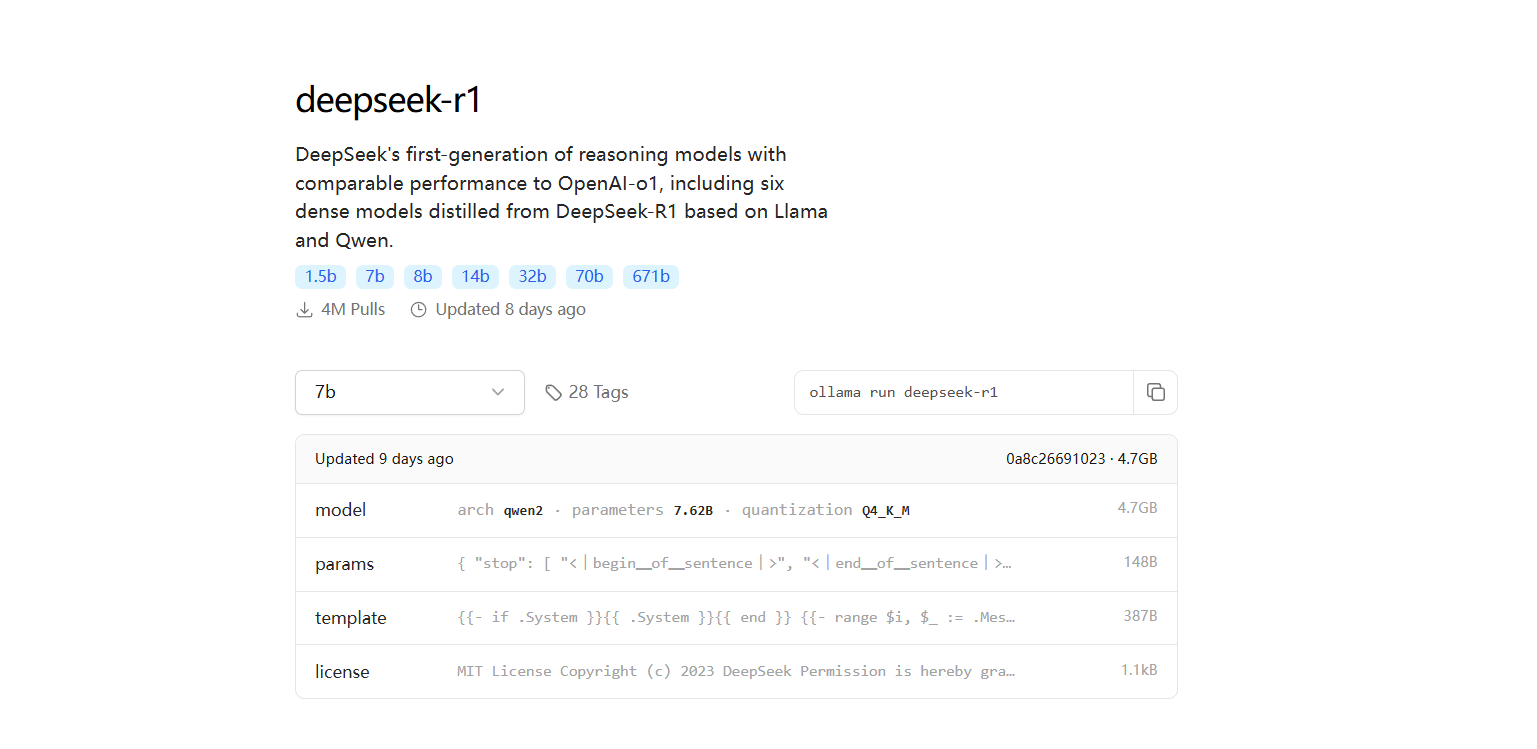

在「Models」標籤下,搜尋關鍵字 「deepseek」,您應該會在清單頂端看到「deepseek-r1」。

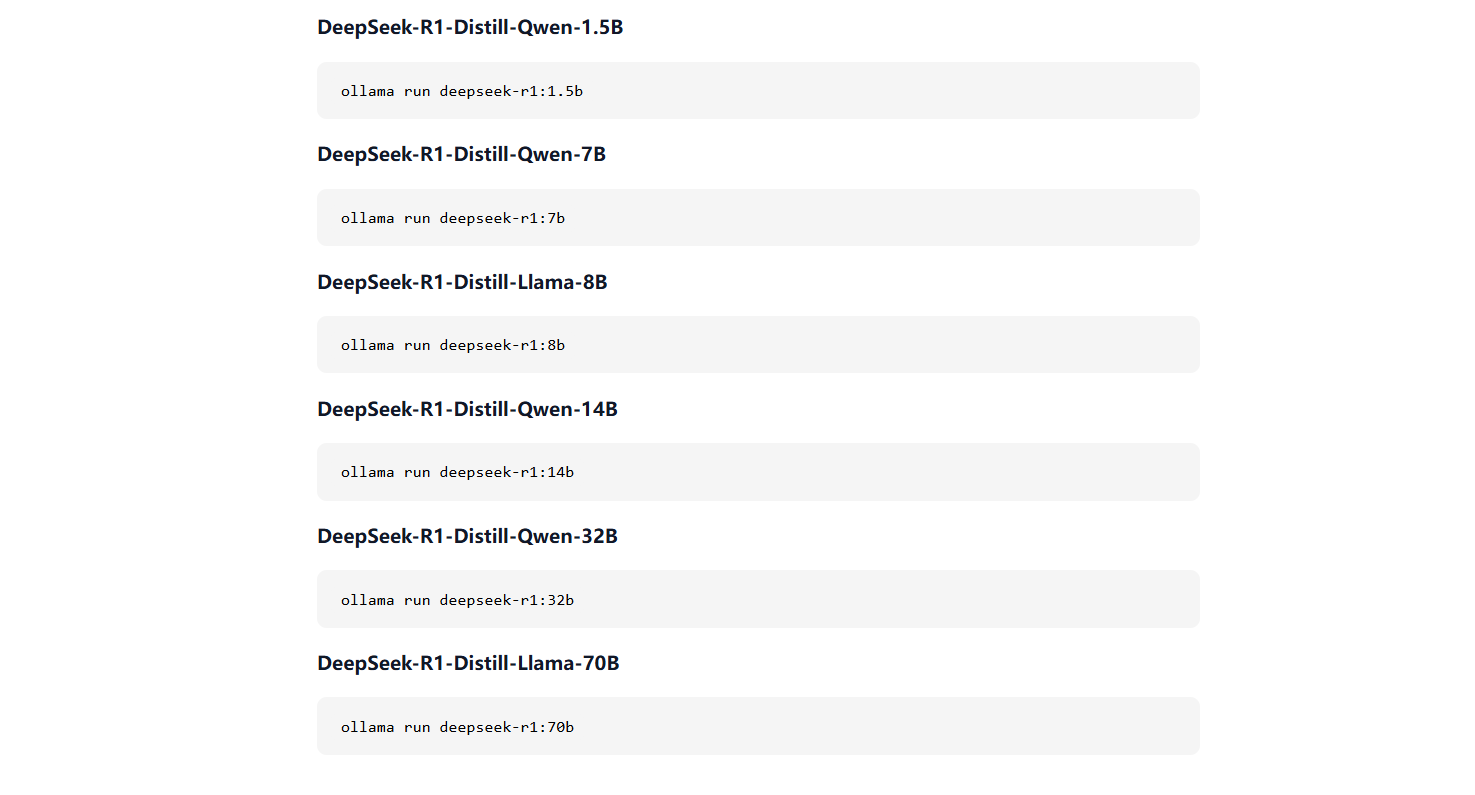

按一下,在「模型」部分,您會看到有多種模型大小,參數從 50 億到 6,710 億不等。一般而言,較大的模型需要更強大的 GPU 才能執行。

像 80 億個參數版本這樣的小模型可以在 8 GB 顯示記憶體的 GPU 上執行,而較大的模型則需要顯著更多的資源(請參閱下面有關顯示記憶體和 GPU 要求的部分)。

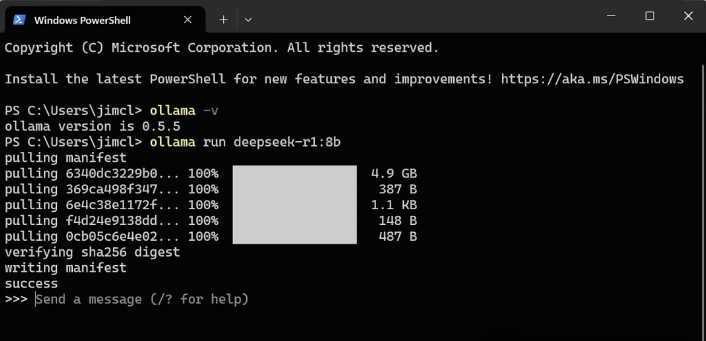

若要下載並執行 80 億參數模型,請使用下列指令:ollama run deepseek-r1:8b

模型將開始下載 (約 4.9 GB)。在繼續之前,請確保您有足夠的磁碟空間。

下載完成後,模型將在本機電腦上執行,您可以立即與它開始對話。

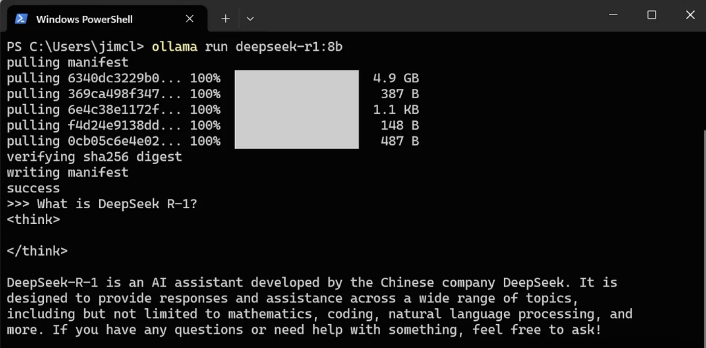

讓我們用一個範例提示來測試一下:

提示: 什麼是 DeepSeek R-1?

回應:DeepSeek R-1 是由中國 DeepSeek 公司開發的人工智能助理。

它旨在提供各種主題的解答和幫助,包括但不限於數學、程式設計、自然語言處理等。如果您有任何問題或需要幫助,歡迎隨時來問我!

太好了

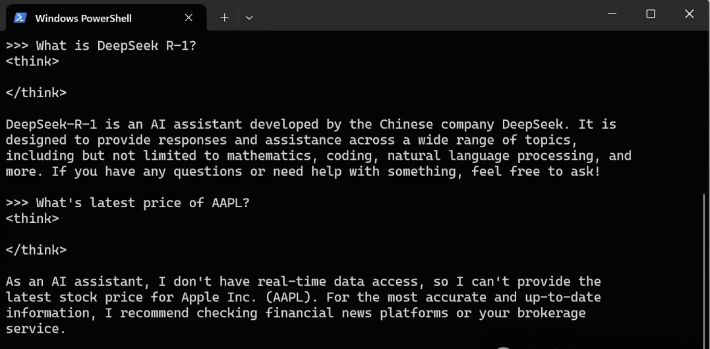

它的速度很快,即使我中斷筆記型電腦與 Wi-Fi 網路的連線也能運作。請注意,即使您連上網路,它也無法存取網際網路。

提示: AAPL 的最新股價是多少?

回應:作為 AI 助手,我無法存取即時資料,因此無法提供 Apple Inc. (AAPL) 的最新股價。

如需最準確的最新資訊,我建議您查看財經新聞平台或您的經紀服務。Ollama 可以做的其他事情:

在本機執行 LLM,包括 LLaMA2、Phi 4、Mistral 和 Gemma 2允許使用者建立和分享自己的 LLM將模型權重、組態和資料打包成單一套件最佳化設定和組態細節,包括 GPU 使用。

GPU 和記憶體需求

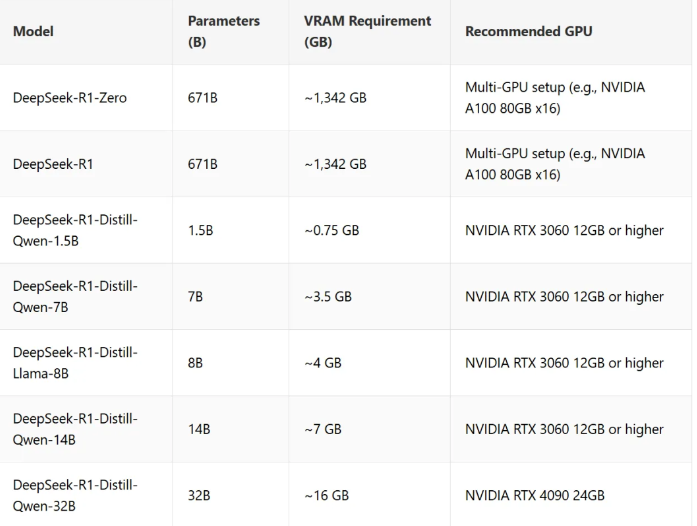

DeepSeek-R1 的記憶體需求取決於模型大小、參數數量和量化技術等因素。

以下是 DeepSeek-R1 及其縮減模型對記憶體需求的詳細概述,以及推薦的 GPU:

記憶體使用的重點說明:

大型模型的分散式 GPU 設定:DeepSeek-R1-Zero 和 DeepSeek-R1 需要大量圖形記憶體,因此需要分散式 GPU 設定 (例如多 GPU 設定中的 NVIDIA A100 或 H100) 以獲得最佳效能。

Lite 機型經過最佳化,可在單一 GPU 上執行,對顯示卡記憶體的要求較低,從 0.7 GB 開始。

額外記憶體使用量:啟動、緩衝區和批次任務可能會消耗額外的記憶體。

為何要在本機執行?

DeepSeek 的網路聊天機器人和行動應用程式都是免費且非常方便的。您不需要做任何設定,DeepThink 和網頁搜尋等功能都是內建的。

然而,在本機執行可能是更好的選擇,原因如下

隱私權

當您使用網頁或應用程式版本時,您的查詢和任何附加檔案都會傳送到 DeepSeek 的伺服器進行處理。我們不知道這些資料會如何處理。在本機執行模型可確保您的資料留在您的電腦上,讓您完全控制您的隱私。

離線存取

在本機執行模型意味著您不需要網際網路連線。

如果您正在旅行、遇到不穩定的 Wi-Fi 或只是喜歡離線工作,本機設定可讓您隨時隨地使用 DeepSeek。

面向未來

目前,DeepSeek 的服務是免費的,但這不可能永遠持續下去。在某個時候,它們可能需要被貨幣化,使用限制或訂閱費用可能會出現。使用本地模式,您可以完全避免這些限制。

靈活

有了本機版本,您就不會受到預設設定的限制。想要微調模型嗎?

與其他工具整合?DeepSeek R1 的開放原始碼特性提供您無限的可能性。

摘要

目前,仍不清楚 DeepSeek 如何處理使用者資料。

如果您不在乎資料隱私,使用網頁或行動應用程式可能是更好的選擇。它們更容易使用,並提供 DeepThink 和網路搜尋等功能。

但如果您關心資料的去向,本機模式是一個值得考慮的好選擇。

DeepSeek 模型的設計,即使在功能不是特別強大的硬體上,也能運作良好。

像 DeepSeek-R1-Zero 這種較大型的機型需要分散式 GPU 設定,而 lite 版本則可讓它在單一 GPU 上以較低的記憶體需求順暢執行。