Principalele aspecte

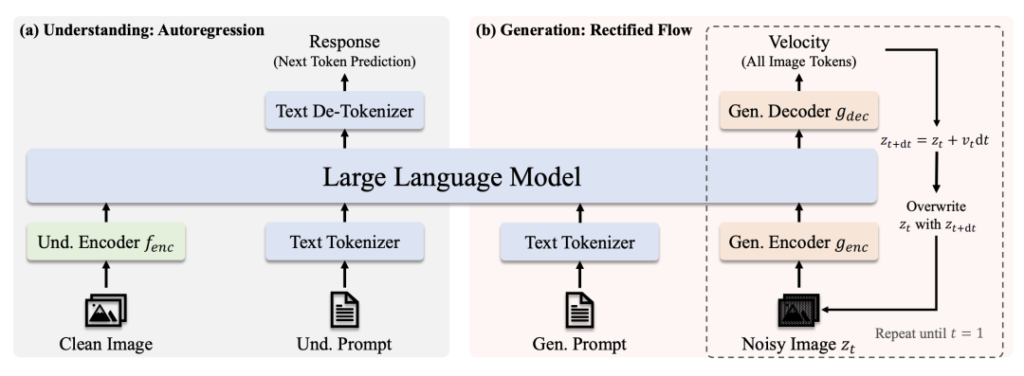

🔹 Arhitectura transformatorului unificat: Un singur model gestionează atât înțelegerea imaginilor și eliminând astfel necesitatea unor sisteme separate.

🔹 Scalabil și Open-Source: Disponibil în 1B și 7B versiuni parametrice (cu licență MIT), optimizate pentru diverse aplicații și utilizare comercială.

🔹 Performanță de ultimă oră: Surclasează DALL-E 3 și Stable Diffusion ale OpenAI în benchmark-uri precum GenEval și DPG-Bench.

🔹 Implementare simplificată: Arhitectura simplificată reduce costurile de formare/inferință, menținând în același timp flexibilitatea.

Legături între modele

- Janus-Pro-7B: HuggingFace

- Janus-Pro-1B: HuggingFace

- GitHub: Cod și documente

De ce iese în evidență Janus-Pro

1. Două superputeri într-un singur model

- Modul de înțelegere: Utilizări SigLIP-L ("super ochelari") pentru a analiza imagini (până la 384×384) și text.

- Modul de generare: Levieri Debit rectificat + SDXL-VAE ("pensula magică") pentru a crea imagini de înaltă calitate.

2. Puterea creierului și formarea

- LLM de bază: Construit pe puternicul model de limbaj DeepSeek (1,5B/7B parametri), excelând în raționamentul contextual.

- Conducta de formare: Pre-antrenare pe seturi masive de date → Reglare fină supervizată → Optimizare EMA pentru performanță maximă.

3. De ce supradifuzia transformatorului?

- Versatilitatea sarcinilor: Prioritizează înțelegerea unificată + generarea, în timp ce modelele de difuzie se concentrează exclusiv pe calitatea imaginii.

- Eficiență: Generarea autoregresivă (un singur pas) vs. denaturarea iterativă a difuziei (de exemplu, 20 de pași pentru difuzia stabilă).

- Cost-eficacitate: Un singur backbone Transformer simplifică instruirea și implementarea.

Poziția dominantă a indicatorului de referință

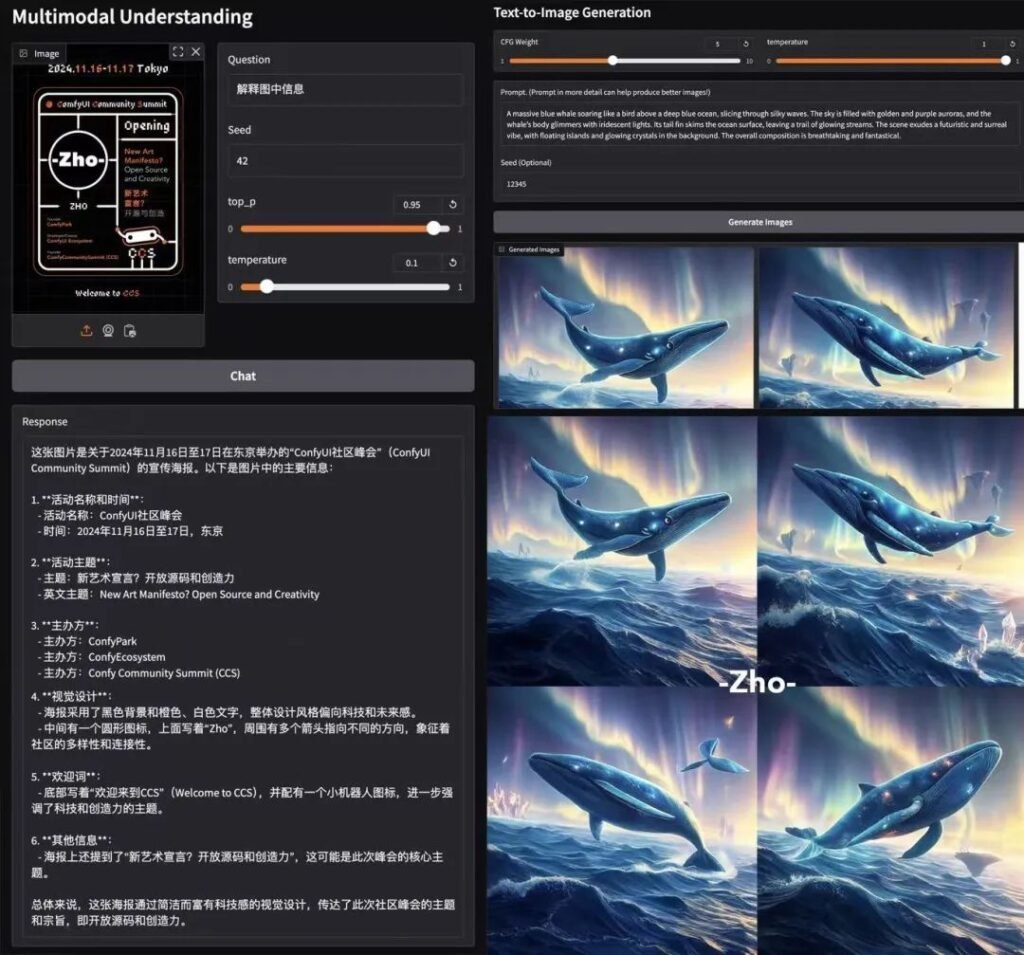

📊 Înțelegerea multimodală

Janus-Pro-7B surclasează modelele specializate (de exemplu, LLaVA) pe patru criterii de referință cheie, cu o scalare lină în funcție de mărimea parametrilor.

🎨 Generarea textului în imagine

- GenEval: Se potrivește cu SDXL și DALL-E 3.

- DPG-Bench: Precizie 84.2% (Janus-Pro-7B), depășind toți concurenții.

Testare în lumea reală

- Viteza: ~15 secunde/imagine (L4 GPU, 22GB VRAM).

- Calitate: Aderență promptă puternică, deși detaliile minore trebuie rafinate.

- Demo Colab: Încercați Janus-Pro-7B (Este necesar nivelul Pro).

Defalcare tehnică

Arhitectură

- Înțelegerea căii: Imagine curată → Codificator SigLIP-L → LLM → Răspuns text.

- Calea de generare: Imagine zgomotoasă → decodor de flux rectificat + LLM → denoising iterativ.

Inovații cheie

- Codificare vizuală decuplată: Căile separate pentru înțelegere/generare previn "conflictul de rol" în modulele de viziune.

- Miez de transformator partajat: Permite transferul de cunoștințe între sarcini (de exemplu, învățarea conceptelor "pisică" ajută atât la recunoaștere, cât și la desen).

Comunitatea Buzz

AK (cercetător AI): "Simplitatea și flexibilitatea Janus-Pro îl fac un candidat principal pentru sistemele multimodale de ultimă generație. Prin decuplarea căilor de vedere, păstrând în același timp un transformator unificat, acesta echilibrează specializarea cu generalizarea - o realizare rară."

De ce contează licența MIT

- Libertate: Utilizați, modificați și distribuiți comercial cu restricții minime.

- Transparență: Accesul complet la cod accelerează îmbunătățirile inițiate de comunitate.

Concluzie

Janus-Pro de la DeepSeek nu este doar un alt model AI - este o schimbare de paradigmă. Prin unificarea înțelegerii și generării sub un singur acoperiș, acesta deschide porți pentru instrumente creative mai inteligente, aplicații în timp real și implementări eficiente din punct de vedere al costurilor. Cu acces open-source și licențiere MIT, acesta ar putea fi catalizatorul următorului val de inovare multimodală. 🚀

Pentru dezvoltatori: Check out the Noduri ComfyUI și alăturați-vă valului de experimentare!

acest post este sponsorizat de: