Principais destaques

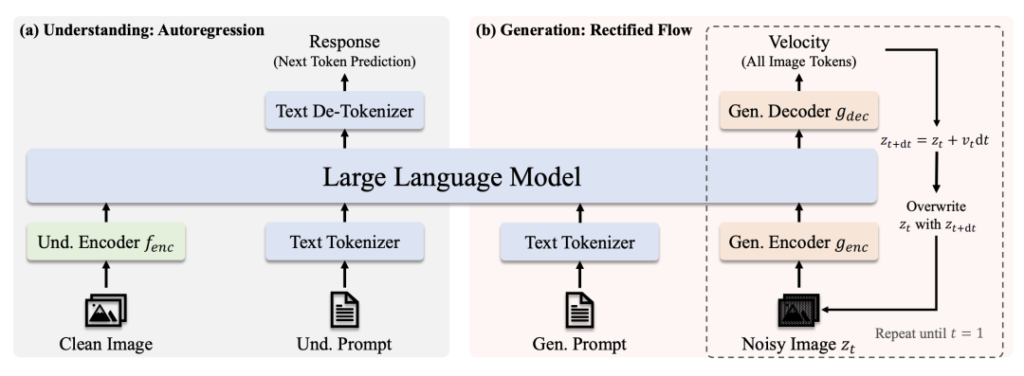

🔹 Arquitetura de transformador unificada: Um único modelo lida com a compreensão da imagem e eliminando a necessidade de sistemas separados.

🔹 Escalável e de código aberto: Disponível em 1B e 7B versões de parâmetros (licenciadas pelo MIT), otimizadas para diversos aplicativos e uso comercial.

🔹 Desempenho de última geração: Supera o desempenho do DALL-E 3 e do Stable Diffusion da OpenAI em benchmarks como GenEval e DPG-Bench.

🔹 Implementação simplificada: A arquitetura simplificada reduz os custos de treinamento/inferência, mantendo a flexibilidade.

Links de modelos

- Janus-Pro-7B: HuggingFace

- Janus-Pro-1B: HuggingFace

- GitHub: Código e documentos

Por que o Janus-Pro se destaca

1. Superpoderes duplos em um único modelo

- Modo de compreensão: Usos SigLIP-L (os "super óculos") para analisar imagens (até 384×384) e texto.

- Modo de geração: Alavancas Fluxo retificado + SDXL-VAE (o "pincel mágico") para criar imagens de alta qualidade.

2. Capacidade cerebral e treinamento

- Núcleo do LLM: Criado com base no poderoso modelo de linguagem do DeepSeek (1,5B/7B parâmetros), excelente em raciocínio contextual.

- Pipeline de treinamento: Pré-treinamento em conjuntos de dados massivos → Ajuste fino supervisionado → Otimização de EMA para desempenho máximo.

3. Por que a superdifusão do transformador?

- Versatilidade de tarefas: Prioriza a compreensão unificada + geração, enquanto os modelos de difusão se concentram puramente na qualidade da imagem.

- Eficiência: Geração autorregressiva (etapa única) vs. redução de ruído iterativa da difusão (por exemplo, 20 etapas para difusão estável).

- Custo-efetividade: Um único backbone do Transformer simplifica o treinamento e a implementação.

Dominância de benchmark

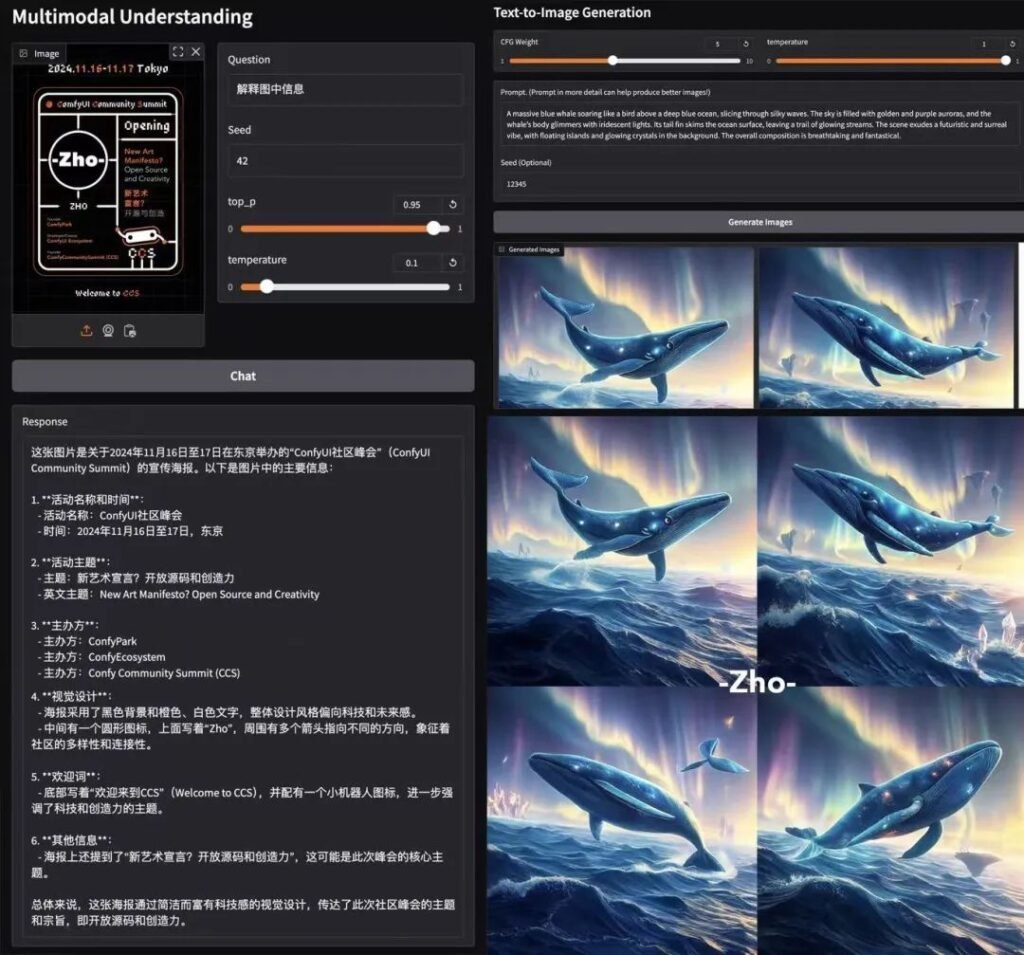

Compreensão multimodal

O Janus-Pro-7B supera os modelos especializados (por exemplo, LLaVA) em quatro benchmarks importantes, escalonando suavemente com o tamanho do parâmetro.

Geração de texto para imagem

- GenEval: Corresponde a SDXL e DALL-E 3.

- DPG-Bench: 84.2% precisão (Janus-Pro-7B), superando todos os concorrentes.

Testes no mundo real

- Velocidade: ~15 segundos/imagem (GPU L4, 22GB VRAM).

- Qualidade: Forte aderência imediata, embora pequenos detalhes precisem ser refinados.

- Demonstração do Colab: Experimente o Janus-Pro-7B (É necessário o nível Pro).

Detalhamento técnico

Arquitetura

- Entendendo o caminho: Imagem limpa → codificador SigLIP-L → LLM → resposta de texto.

- Caminho de geração: Imagem com ruído → Decodificador de fluxo retificado + LLM → Redução iterativa de ruído.

Principais inovações

- Codificação visual desacoplada: Caminhos separados para compreensão/geração evitam o "conflito de funções" nos módulos de visão.

- Núcleo de transformador compartilhado: Permite a transferência de conhecimento entre tarefas (por exemplo, aprender conceitos de "gato" ajuda tanto no reconhecimento quanto no desenho).

Buzz da comunidade

AK (pesquisador de IA): "A simplicidade e a flexibilidade do Janus-Pro fazem dele o principal candidato para sistemas multimodais de última geração. Ao desacoplar as vias de visão e manter um Transformer unificado, ele equilibra a especialização com a generalização - um feito raro."

Por que a licença MIT é importante

- Liberdade: Use, modifique e distribua comercialmente com restrições mínimas.

- Transparência: O acesso total ao código acelera os aprimoramentos conduzidos pela comunidade.

Conclusão final

O Janus-Pro da DeepSeek não é apenas mais um modelo de IA - é uma mudança de paradigma. Ao unificar a compreensão e a geração em um só lugar, ele abre portas para ferramentas criativas mais inteligentes, aplicativos em tempo real e implementações econômicas. Com acesso de código aberto e licenciamento do MIT, esse pode ser o catalisador para a próxima onda de inovação multimodal. 🚀

Para desenvolvedores: Confira o Nós da ComfyUI e participe da onda de experimentação!

esta postagem é patrocinada por: