Öppen AI brådskande finansiering

Med DeepSeeks genomslagskraft är Silicon Valley bara för spännande.

Igår var OpenAI och Anthropic fortfarande ledande och försökte på alla möjliga sätt att sätta käppar i hjulet för konkurrenterna. Över en natt har infrastrukturleverantörerna plötsligt blivit "riktigt intresserade".

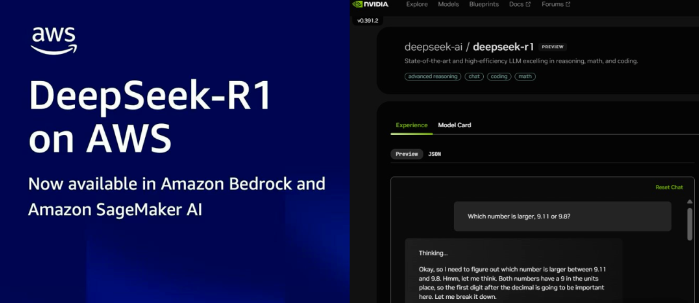

Efter Microsoft har även NVIDIA och AWS påskyndat lanseringen av DeepSeek-modellens hostingtjänster.

Som en användare kommenterade på NVIDIA:s officiella Twitter-konto: "Om du inte kan slå dem, gå med dem."

Låt oss ta en titt på vart och ett av dessa drag.

Först några nya nyheter: OpenAI:s senaste svar tillkännagavs idag: insamling, insamling, insamling.

Wall Street Journal rapporterade om nyheten att OpenAI söker en ny finansieringsrunda om US$40 miljarder (cirka 287,5 miljarder yuan) till en värdering om US$300 miljarder -

vilket skulle slå rekordet för den högsta enskilda finansieringsrundan i Silicon Valley, som innehas av OpenAI självt.

Denna finansieringsrunda leds av SoftBank. Tidigare nyheter indikerade att SoftBank planerar att investera upp till $25 miljarder (cirka 179,7 miljarder yuan) i OpenAI denna gång.

Och detta är bara fyra månader efter att OpenAI tog in $6,6 miljarder till en värdering av $157 miljarder.

På bara några månader har värderingen fördubblats igen, vilket också bekräftar ryktena på marknaden: OpenAI var inte nöjda med den senaste finansieringsrundan.

Och nu kan OpenAI verkligen vara lite desperat:

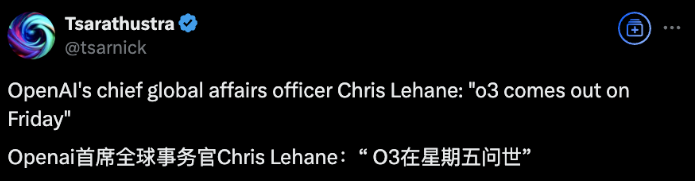

En annan nyhet är att o3 kommer att släppas på fredag lokal tid.

Men när det gäller AI-applikationer är situationen lite annorlunda.

Cursor, som är en favorit bland programmerare, har till exempel redan öppet anammat den nya modellen och uppmanar alla att testa den tillsammans för att se de verkliga resultaten.

Det är bara modellleverantörerna i mitten som lämnas vind för våg. För molntjänster och applikationer är det bara rätt att stödja dem alla först (doge).

För mer information, låt oss fortsätta chatta.

Vi ses på fredag med Open AI o3

Enligt läckan är ett av syftena med OpenAI:s insamling att uppfylla sitt löfte till Stargate-projektet.

Detta projekt leds av OpenAI och SoftBank, med Arm, Microsoft, NVIDIA och Oracle som viktiga teknikpartners. Målet är att investera $500 miljarder (ca 3,64 biljoner yuan) under de kommande fyra åren för att bygga flera AI-datacenter i USA.

OpenAI:s åtagande är: $100 miljarder.

Det officiella tillkännagivandet avslöjade en del detaljer:

The Stargate Project är ett nytt företag som planerar att investera $500 miljarder under de kommande fyra åren för att bygga ny AI-infrastruktur för OpenAI i USA. Vi kommer omedelbart att investera $100 miljarder.

Bland de första finansiärerna av projektet finns SoftBank, OpenAI, Oracle och Mellanösterns AI-fond MGX. SoftBank och OpenAI är huvudpartners i projektet, med SoftBank som ansvarig för finans och OpenAI som ansvarig för verksamheten. Masayoshi Son kommer att fungera som ordförande.

Arm, Microsoft, NVIDIA, Oracle och OpenAI är viktiga initiala teknikpartners. Byggnationen pågår för närvarande, med början i Texas, och vi utvärderar potentiella platser över hela landet för att bygga ytterligare campus samtidigt som vi slutför avtal.

Som en del av Stargate-projektet kommer Oracle, NVIDIA och OpenAI att arbeta nära tillsammans för att bygga och driva datorsystemet. Detta bygger vidare på det djupa samarbetet mellan OpenAI och NVIDIA sedan 2016, samt det nya samarbetet mellan OpenAI och Oracle.

Det bygger också vidare på OpenAI:s befintliga relation med Microsoft. OpenAI kommer att fortsätta att öka sin användning av Azure eftersom man fortsätter att arbeta med Microsoft för att utnyttja ytterligare beräkningskraft för att träna ledande modeller och leverera exceptionella produkter och tjänster.

Dessutom kommer pengarna också att användas av OpenAI för att täcka förluster. Även om OpenAI:s månadsintäkter i augusti 2024 nådde 300 miljoner US-dollar, en ökning med 1700% jämfört med början av 2023, förväntas OpenAI i oktober ha en helårsförlust på 5 miljarder US-dollar.

Tillsammans med nyheten om finansieringen kom den senaste tidsplanen för o3.

I en intervju med NPR avslöjade OpenAI Chief Global Affairs Officer Chris Lehane:

o3 kommer att släppas på fredag.

Så snart nyheten kom ut var internetanvändaren Xiaomaza redo.

Vissa Internetanvändare påpekade dock att det han menade med "o3" fortfarande var o3-mini, och Altman själv hade för länge sedan meddelat lanseringen av denna modell.

Trots kontroversen väcker DeepSeek trots allt mer diskussion och beröm på andra sidan Atlanten

DeepSeek är riktigt bra

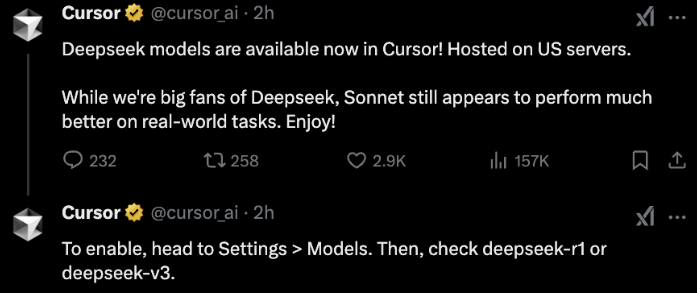

Efter att Microsoft pekade fingrarna kopplade den omedelbart sin AI-plattform till DeepSeek-modellen. Idag meddelade Cursor, en favorit bland programmerare, också de senaste nyheterna:

DeepSeek-modellen är nu tillgänglig på Cursor.

Det är värt att notera att Cursor nämnde att Sonnet 3.5 fortfarande är bättre än DeepSeeks nya modell när det gäller faktiska programmeringsuppgifter.

Cursors tjänstemän gav dock inte något konkret exempel, vilket väckte nyfikenhet hos åskådarna:

Det verkar som om det är dags att tala med verkliga mätningar. Om du redan har haft en chans att prova det kan du lika gärna dela din erfarenhet med oss i kommentarfältet.

På samma sätt har den högljudda Anthropic, vars finansiär AWS också har varit den första att anta DeepSeek-modellen, inte alls tvekat på grund av kontroversen (doge).

Ett annat företag som har fått mer uppmärksamhet är NVIDIA, vars aktiekurs verkligen har lyfts av DeepSeek-.

DeepSeek-R1 är redan tillgängligt på NVIDIA NIM-plattformen. NVIDIA har också gjort ett stort väsen av det:

DeepSeek-R1 är en öppen källkodsmodell med toppmoderna inferensfunktioner. Inferensmodeller som DeepSeek-R1 ger inte direkta svar, utan utför inferens på frågor för att generera det bästa svaret genom tankekedjor, konsensus och sökmetoder.

DeepSeek-R1 är ett perfekt exempel på Scaling Law i testning, vilket visar varför accelererad databehandling är avgörande för inferensbehoven hos proxy-AI.

NVIDIA säger att DeepSeek-R1 NIM-mikrotjänster kan leverera 3 872 tokens per sekund på ett enda NVIDIA HGX H200-system.

Och det finns också fler och fler avvikande röster som dyker upp som svar på Anthropics och andra som står inför DeepSeek-konkurrensens oansvariga reaktioner.

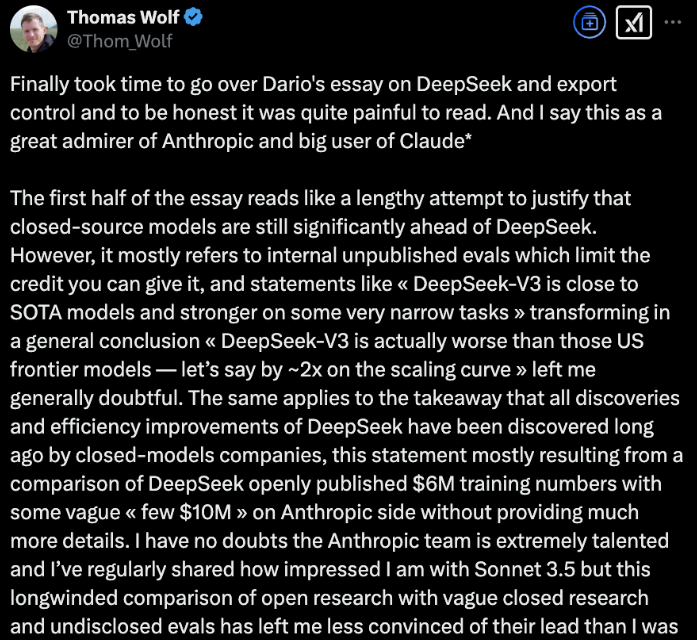

Till exempel kritiserade HuggingFace medgrundare Thomas Wolf direkt:

Ärligt talat var Darios artikel mycket smärtsam att läsa.

I sin korta essä skrev han:

Att jämföra forskning med öppen källkod med vagt sluten forskning och opublicerade utvärderingar har gjort mig mindre säker på Anthropics ledande position än tidigare.

Ännu viktigare är att med utvecklingen av Open-R1 och DeepSeek-papperet kommer team från hela världen att släppa inferensmodeller med öppen källkod under de kommande månaderna. Idag släppte till exempel Allen Institute och Mistral Tülu respektive Small3 för att komma ikapp DeepSeek-V3.

Öppen källkod kommer att bli allt viktigare för vår säkerhet.

Vad tycker du om det?