IA aberta financiamento urgente

Com o DeepSeek causando impacto, o Vale do Silício é muito empolgante.

Ontem, a OpenAI e a Anthropic ainda estavam liderando o ataque, tentando todos os meios possíveis para enganar a concorrência. De um dia para o outro, os fornecedores de infraestrutura de repente se tornaram "realmente interessados".

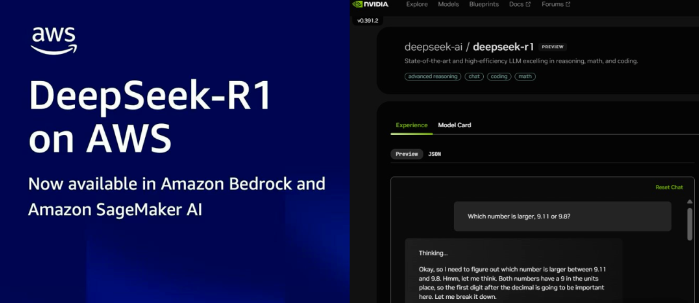

Depois da Microsoft, a NVIDIA e a AWS também aceleraram o lançamento dos serviços de hospedagem do modelo DeepSeek.

Como um usuário comentou na conta oficial da NVIDIA no Twitter, "Se você não pode vencê-los, junte-se a eles".

Vamos dar uma olhada em cada um desses movimentos.

Primeiro, algumas notícias novas: A resposta mais recente da OpenAI foi anunciada hoje: captação de recursos, captação de recursos, captação de recursos.

O Wall Street Journal divulgou a notícia de que OpenAI está buscando uma nova rodada de financiamento de US$40 bilhões (aproximadamente 287,5 bilhões de yuans) em uma avaliação de US$300 bilhões -

o que quebraria o recorde de maior rodada única de financiamento no Vale do Silício, mantido pela própria OpenAI.

Essa rodada de financiamento é liderada pela SoftBank. Notícias anteriores indicaram que a SoftBank planeja investir até $25 bilhões (cerca de 179,7 bilhões de yuans) na OpenAI desta vez.

E isso apenas quatro meses depois que a OpenAI levantou $6,6 bilhões em uma avaliação de $157 bilhões.

Em apenas alguns meses, a avaliação dobrou novamente, o que também confirma os rumores do mercado: A OpenAI não ficou satisfeita com a última rodada de financiamento.

E agora, a OpenAI pode realmente estar um pouco desesperada:

Outra notícia é que o o3 será lançado na sexta-feira, horário local.

Mas o lado do aplicativo de IA da história é um pouco diferente.

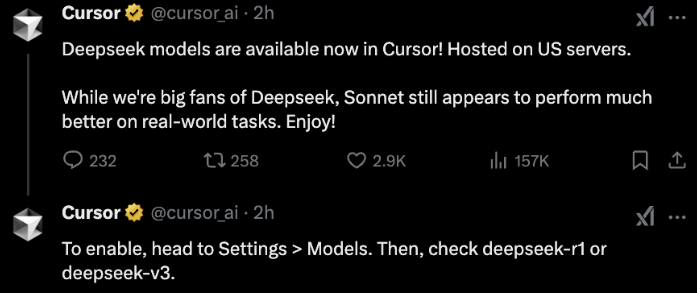

Por exemplo, o Cursor, um dos favoritos dos programadores, já adotou abertamente o novo modelo, convidando todos a testá-lo juntos para ver os resultados reais.

Somente os fornecedores de modelos que estão no meio são deixados à deriva. Para serviços e aplicativos em nuvem, é correto oferecer suporte a todos eles primeiro (doge).

Para obter mais detalhes, vamos continuar conversando.

Vejo você na sexta-feira com o Open AI o3

De acordo com o vazamento, um dos objetivos da arrecadação de fundos da OpenAI é cumprir sua promessa ao projeto Stargate.

Esse projeto é liderado pela OpenAI e pela SoftBank, com a Arm, a Microsoft, a NVIDIA e a Oracle como principais parceiros tecnológicos. O objetivo é investir $500 bilhões (cerca de 3,64 trilhões de yuans) nos próximos quatro anos para construir vários data centers de IA nos Estados Unidos.

O compromisso da OpenAI é: $100 bilhões.

O anúncio oficial revelou alguns detalhes:

O Projeto Stargate é uma nova empresa que planeja investir $500 bilhões nos próximos quatro anos para construir uma nova infraestrutura de IA para a OpenAI nos Estados Unidos. Investiremos imediatamente $100 bilhões.

Os financiadores iniciais de capital do projeto incluem a SoftBank, a OpenAI, a Oracle e o fundo de IA do Oriente Médio MGX. A SoftBank e a OpenAI são os principais parceiros do projeto, sendo a SoftBank responsável pelas finanças e a OpenAI pelas operações. Masayoshi Son atuará como presidente do conselho.

Arm, Microsoft, NVIDIA, Oracle e OpenAI são os principais parceiros tecnológicos iniciais. A construção está em andamento, começando no Texas, e estamos avaliando possíveis locais em todo o país para construir campi adicionais enquanto finalizamos os acordos.

Como parte do projeto Stargate, a Oracle, a NVIDIA e a OpenAI trabalharão em estreita colaboração para criar e operar o sistema de computação. Isso se baseia na profunda colaboração entre a OpenAI e a NVIDIA desde 2016, bem como na nova colaboração entre a OpenAI e a Oracle.

Ele também se baseia no relacionamento existente da OpenAI com a Microsoft. A OpenAI continuará a aumentar o uso do Azure à medida que continua a trabalhar com a Microsoft para aproveitar o poder de computação adicional para treinar modelos líderes e fornecer produtos e serviços excepcionais.

Além disso, o dinheiro também será usado pela OpenAI para cobrir perdas. Embora em agosto de 2024, a receita mensal da OpenAI tenha atingido 300 milhões de dólares americanos, um aumento de 1700% em comparação com o início de 2023, em outubro, espera-se que a OpenAI tenha um prejuízo de 5 bilhões de dólares americanos no ano inteiro.

Junto com a notícia do financiamento, veio o último cronograma da o3.

Em uma entrevista à NPR, o diretor de assuntos globais da OpenAI, Chris Lehane, revelou:

O o3 será lançado na sexta-feira.

Assim que a notícia foi divulgada, o usuário da Internet Xiaomaza estava pronto.

No entanto, alguns usuários da Internet apontaram que o que ele queria dizer com "o3" ainda era o o3-mini, e o próprio Altman já havia anunciado o lançamento desse modelo há muito tempo.

Afinal, apesar da controvérsia, o DeepSeek está provocando mais discussões e elogios em todo o mundo

DeepSeek é realmente bom

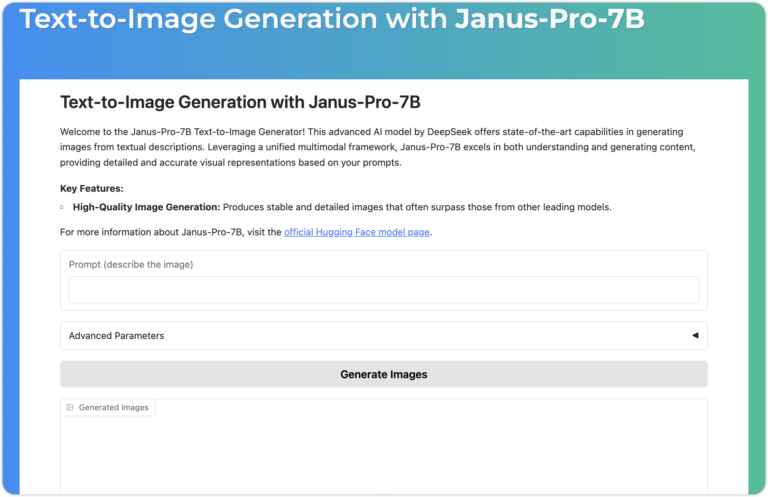

Depois que a Microsoft apontou seus dedos, ela imediatamente conectou sua plataforma de IA ao modelo DeepSeek. Hoje, o Cursor, um dos favoritos dos programadores, também anunciou as últimas notícias:

o modelo DeepSeek já está disponível no Cursor.

Vale a pena observar que a Cursor mencionou que, em tarefas reais de programação, o Sonnet 3.5 ainda é melhor do que o novo modelo da DeepSeek.

No entanto, os funcionários da Cursor não deram um exemplo específico, o que despertou a curiosidade dos espectadores:

Parece que chegou a hora de falar com medidas do mundo real. Se você já teve a chance de experimentar, compartilhe sua experiência conosco na seção de comentários.

Da mesma forma, o barulhento Anthropic, cujo patrocinador, a AWS, também foi o primeiro a adotar o modelo DeepSeek, não hesitou em nada devido à controvérsia (doge).

Outra empresa que atraiu mais atenção foi a NVIDIA, cujo preço das ações foi realmente impulsionado pelo DeepSeek-

O DeepSeek-R1 já está disponível na plataforma NVIDIA NIM. A NVIDIA também fez um grande alarde sobre isso:

O DeepSeek-R1 é um modelo de código aberto com recursos de inferência de última geração. Modelos de inferência como o DeepSeek-R1 não fornecem respostas diretas, mas realizam inferência em consultas para gerar a melhor resposta por meio de cadeias de pensamento, consenso e métodos de pesquisa.

O DeepSeek-R1 é um exemplo perfeito da Lei da Escala em testes, provando por que a computação acelerada é essencial para as necessidades de inferência da IA proxy.

A NVIDIA diz que os microsserviços DeepSeek-R1 NIM podem fornecer 3.872 tokens por segundo em um único sistema NVIDIA HGX H200.

E também há cada vez mais vozes dissidentes surgindo em resposta às reações indiferentes da Anthropic e de outras empresas que enfrentam a concorrência do DeepSeek.

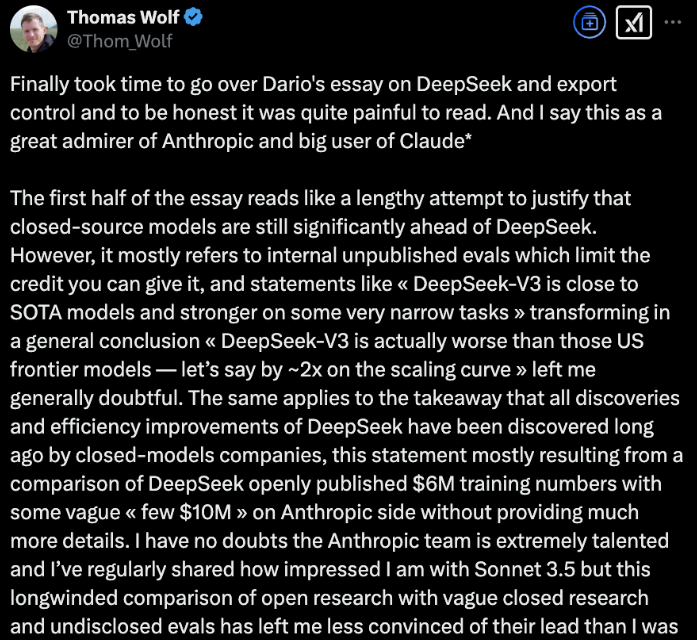

Por exemplo, o cofundador do HuggingFace, Thomas Wolf, criticou diretamente:

Para ser sincero, a leitura do artigo de Dario foi muito dolorosa.

Em seu breve ensaio, ele escreveu:

A comparação da pesquisa de código aberto com pesquisas vagas e fechadas e avaliações não publicadas me deixou menos confiante na posição de liderança da Anthropic do que antes.

Mais importante ainda, com o desenvolvimento do Open-R1 e do artigo do DeepSeek, equipes de todo o mundo lançarão modelos de inferência de código aberto nos próximos meses. Por exemplo, hoje, o Allen Institute e a Mistral lançaram o Tülu e o Small3, respectivamente, para acompanhar o DeepSeek-V3.

O código aberto se tornará cada vez mais importante para nossa segurança.

O que você acha?