IA abierta financiación urgente

Con el impacto de DeepSeek, Silicon Valley es demasiado emocionante.

Ayer, OpenAI y Anthropic seguían a la cabeza, intentando por todos los medios poner la zancadilla a la competencia. De la noche a la mañana, los proveedores de infraestructuras se han vuelto "realmente interesados".

Tras Microsoft, NVIDIA y AWS también han acelerado el lanzamiento de los servicios de alojamiento del modelo DeepSeek.

Como comentó un usuario en la cuenta oficial de NVIDIA en Twitter: "Si no puedes vencerlos, únete a ellos".

Veamos cada uno de estos movimientos.

En primer lugar, nuevas noticias: Hoy se ha anunciado la última respuesta de OpenAI: recaudar fondos, recaudar fondos, recaudar fondos.

El Wall Street Journal dio la noticia de que OpenAI busca una nueva ronda de financiación de $40.000 millones de dólares (aproximadamente 287.500 millones de yuanes) a una valoración de $300.000 millones de dólares. -

lo que batiría el récord de la mayor ronda de financiación individual en Silicon Valley, que ostenta la propia OpenAI.

Esta ronda de financiación está liderada por SoftBank. Noticias anteriores indicaban que SoftBank tiene previsto invertir hasta 1.000 millones de euros en la ronda de financiación. $25 mil millones (unos 179.700 millones de yuanes) en OpenAI esta vez.

Y esto sólo cuatro meses después de que OpenAI recaudara $6.600 millones con una valoración de $157.000 millones.

En pocos meses, la valoración se ha duplicado de nuevo, lo que confirma también los rumores del mercado: OpenAI no quedó satisfecha con la última ronda de financiación.

Y ahora, OpenAI puede estar realmente un poco desesperada:

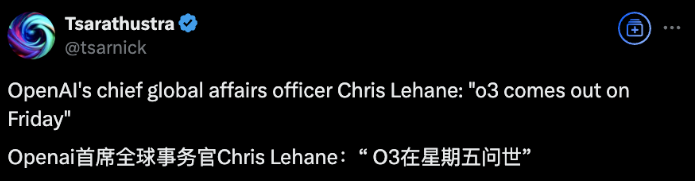

Otra noticia es que o3 saldrá a la venta el viernes, hora local.

Pero el lado de la aplicación de la IA es un poco diferente.

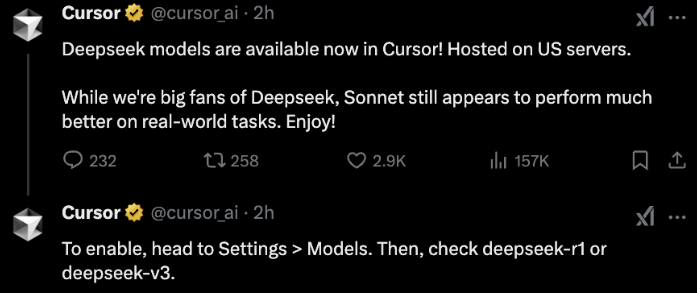

Por ejemplo, Cursor, uno de los favoritos de los programadores, ya ha adoptado abiertamente el nuevo modelo, y ha pedido a todos que lo prueben juntos para ver los resultados reales.

Sólo los vendedores de modelos en el centro quedan zarandeados por el viento. En el caso de los servicios y aplicaciones en la nube, lo correcto es darles soporte a todos primero (doge).

Para más detalles, sigamos charlando.

Nos vemos el viernes con Open AI o3

Según la filtración, uno de los propósitos de la recaudación de fondos de OpenAI es cumplir su promesa al proyecto Stargate.

Este proyecto está liderado por OpenAI y SoftBank, con Arm, Microsoft, NVIDIA y Oracle como socios tecnológicos clave. El objetivo es invertir $500.000 millones (unos 3,64 billones de yuanes) en los próximos cuatro años para construir múltiples centros de datos de IA en Estados Unidos.

El compromiso de OpenAI es: $100 mil millones.

El anuncio oficial reveló algunos detalles:

El Proyecto Stargate es una nueva empresa que planea invertir $500.000 millones en los próximos cuatro años para construir una nueva infraestructura de IA para OpenAI en Estados Unidos. Invertiremos inmediatamente $100 mil millones.

Entre los financiadores iniciales del proyecto se encuentran SoftBank, OpenAI, Oracle y el fondo de inteligencia artificial MGX de Oriente Medio. SoftBank y OpenAI son los socios principales del proyecto, siendo SoftBank responsable de las finanzas y OpenAI responsable de las operaciones. Masayoshi Son será el presidente.

Arm, Microsoft, NVIDIA, Oracle y OpenAI son socios tecnológicos iniciales clave. La construcción está actualmente en marcha, comenzando en Texas, y estamos evaluando posibles ubicaciones en todo el país para construir campus adicionales mientras finalizamos los acuerdos.

Como parte del proyecto Stargate, Oracle, NVIDIA y OpenAI colaborarán estrechamente para construir y operar el sistema de computación. Esto se basa en la profunda colaboración entre OpenAI y NVIDIA desde 2016, así como en la nueva colaboración entre OpenAI y Oracle.

También se basa en la relación existente entre OpenAI y Microsoft. OpenAI seguirá aumentando su uso de Azure mientras continúa trabajando con Microsoft para aprovechar la potencia de cálculo adicional para entrenar modelos líderes y ofrecer productos y servicios excepcionales.

Además, el dinero también será utilizado por OpenAI para cubrir pérdidas. Aunque en agosto de 2024, los ingresos mensuales de OpenAI alcanzaron los 300 millones de dólares estadounidenses, un aumento de 1700% en comparación con principios de 2023, en octubre se espera que OpenAI tenga unas pérdidas de 5.000 millones de dólares estadounidenses en todo el año.

Junto con la noticia de la financiación llegó el último calendario de o3.

En una entrevista con NPR, el Director de Asuntos Globales de OpenAI, Chris Lehane, reveló:

o3 saldrá a la venta el viernes.

En cuanto saltó la noticia, el internauta Xiaomaza estaba preparado.

Sin embargo, algunos internautas señalaron que lo que quería decir con "o3" seguía siendo o3-mini, y que el propio Altman había anunciado hacía tiempo el lanzamiento de este modelo.

Al fin y al cabo, a pesar de la polémica, DeepSeek está suscitando más debates y elogios al otro lado del charco

DeepSeek es realmente bueno

Después de que Microsoft señalara con el dedo, conectó inmediatamente su plataforma de IA con el modelo DeepSeek. Hoy, Cursor, una de las favoritas de los programadores, también ha anunciado las últimas novedades:

el modelo DeepSeek ya está disponible en Cursor.

Cabe destacar que Cursor mencionó que en tareas de programación reales, el Sonnet 3.5 sigue siendo mejor que el nuevo modelo de DeepSeek.

Sin embargo, los responsables de Cursor no dieron ningún ejemplo concreto, lo que despertó la curiosidad de los curiosos:

Parece que ha llegado el momento de hablar con medidas reales. Si ya has tenido ocasión de probarlo, puedes compartir tu experiencia con nosotros en la sección de comentarios.

Del mismo modo, el bocazas Anthropic, cuyo patrocinador, AWS, también ha sido el primero en adoptar el modelo DeepSeek, no ha dudado en absoluto debido a la polémica (doge).

Otra empresa que ha atraído más atención es NVIDIA, cuya cotización en bolsa se ha visto realmente impulsada por DeepSeek.

DeepSeek-R1 ya está disponible en la plataforma NIM de NVIDIA. NVIDIA también ha hecho mucho ruido al respecto:

DeepSeek-R1 es un modelo de código abierto con capacidades de inferencia de última generación. Los modelos de inferencia como DeepSeek-R1 no dan respuestas directas, sino que realizan inferencia sobre las consultas para generar la mejor respuesta mediante cadenas de pensamiento, consenso y métodos de búsqueda.

DeepSeek-R1 es un ejemplo perfecto de la Ley de Escalado en las pruebas, lo que demuestra por qué la computación acelerada es esencial para las necesidades de inferencia de la IA proxy.

NVIDIA afirma que los microservicios NIM DeepSeek-R1 pueden suministrar 3.872 tokens por segundo en un único sistema NVIDIA HGX H200.

Y también surgen cada vez más voces discordantes ante las reacciones poco receptivas de Anthropic y otros que se enfrentan a la competencia de DeepSeek.

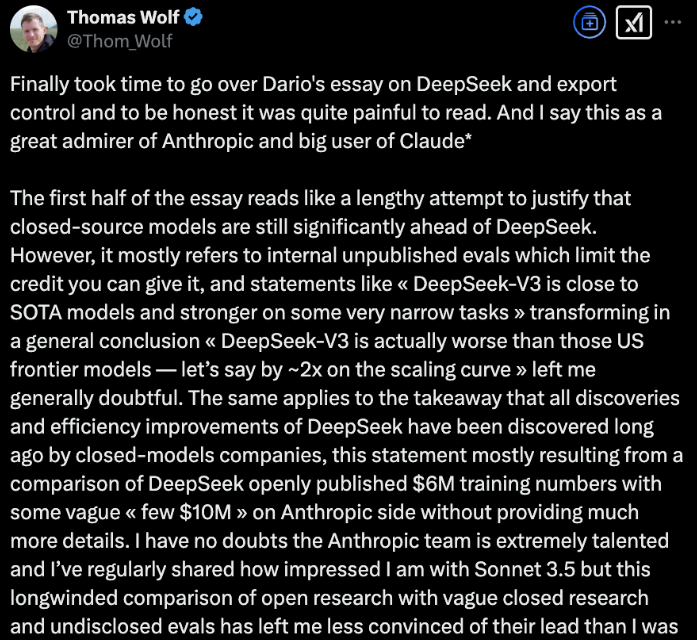

Por ejemplo, el cofundador de HuggingFace, Thomas Wolf, criticó directamente:

Para ser honesto, el artículo de Darío fue muy doloroso de leer.

En su breve ensayo, escribió:

La comparación de la investigación de código abierto con la vaga investigación cerrada y las evaluaciones no publicadas me ha hecho confiar menos que antes en la posición de liderazgo de Anthropic.

Y lo que es más importante, con el desarrollo de Open-R1 y el documento DeepSeek, equipos de todo el mundo publicarán modelos de inferencia de código abierto en los próximos meses. Por ejemplo, hoy, el Allen Institute y Mistral han publicado Tülu y Small3, respectivamente, para ponerse a la altura de DeepSeek-V3.

El código abierto será cada vez más importante para nuestra seguridad.

¿Qué le parece?