Főbb jellemzők

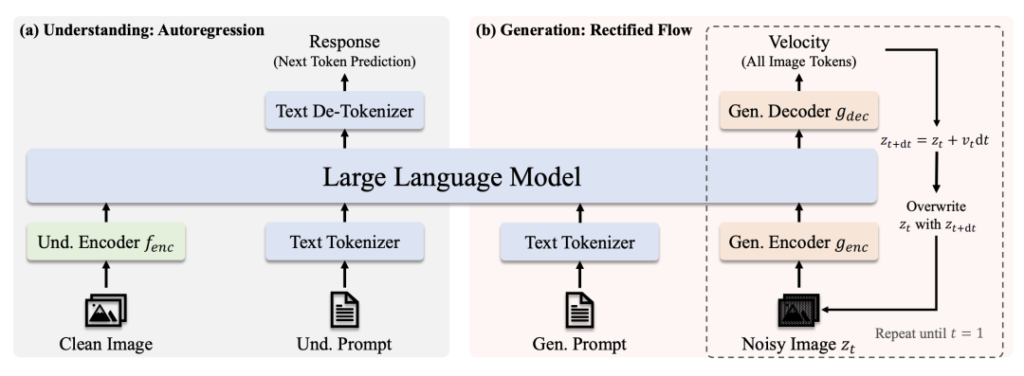

🔹 Egységes transzformátor architektúra: Egyetlen modell kezeli a képmegértést és generáció, így nincs szükség különálló rendszerekre.

🔹 Skálázható és nyílt forráskódú: Elérhető 1B és 7B paraméteres változatok (MIT-licenc), különféle alkalmazásokra és kereskedelmi felhasználásra optimalizálva.

🔹 Korszerű teljesítmény: Túlszárnyalja az OpenAI DALL-E 3 és a Stable Diffusion teljesítményét olyan benchmarkokban, mint a GenEval és a DPG-Bench.

🔹 Egyszerűsített telepítés: Az egyszerűsített architektúra csökkenti a képzési/beavatkozási költségeket, miközben fenntartja a rugalmasságot.

Modell linkek

- Janus-Pro-7B: HuggingFace

- Janus-Pro-1B: HuggingFace

- GitHub: Kód és dokumentumok

Miért emelkedik ki az Janus-Pro

1. Kettős szupererő egy modellben

- A mód megértése: Használja SigLIP-L (a "szuper szemüveg") a képek (akár 384×384) és a szöveg elemzésére.

- Generálási mód: A Rektifikált áramlás + SDXL-VAE (a "varázs ecset") segítségével kiváló minőségű képeket készíthet.

2. Agyerő és képzés

- Core LLM: A DeepSeek nagy teljesítményű nyelvi modelljére épül (1,5B/7B paraméter), amely kiemelkedő a kontextuális következtetésben.

- Képzési csővezeték: Előzetes képzés hatalmas adathalmazokon → felügyelt finomhangolás → EMA optimalizálás a csúcsteljesítmény érdekében.

3. Miért a transzformátor túlterjedése?

- Feladat sokoldalúság: Az egységes megértést + generálást helyezi előtérbe, míg a diffúziós modellek pusztán a képminőségre összpontosítanak.

- Hatékonyság: Autoregresszív generálás (egylépéses) vs. a diffúzió iteratív zajmentesítése (pl. 20 lépés a stabil diffúzió esetében).

- Költséghatékonyság: Egyetlen Transformer gerinchálózat egyszerűsíti a képzést és a telepítést.

Benchmark dominancia

📊 Multimodális megértés

Az Janus-Pro-7B négy kulcsfontosságú benchmarkon felülmúlja a speciális modelleket (pl. LLaVA), és a paraméterek méretével egyenletesen skálázódik.

🎨 Szöveg-kép generálása

- GenEval: SDXL és DALL-E 3.

- DPG-Bench: 84.2% pontosság (Janus-Pro-7B), felülmúlva minden versenytársat.

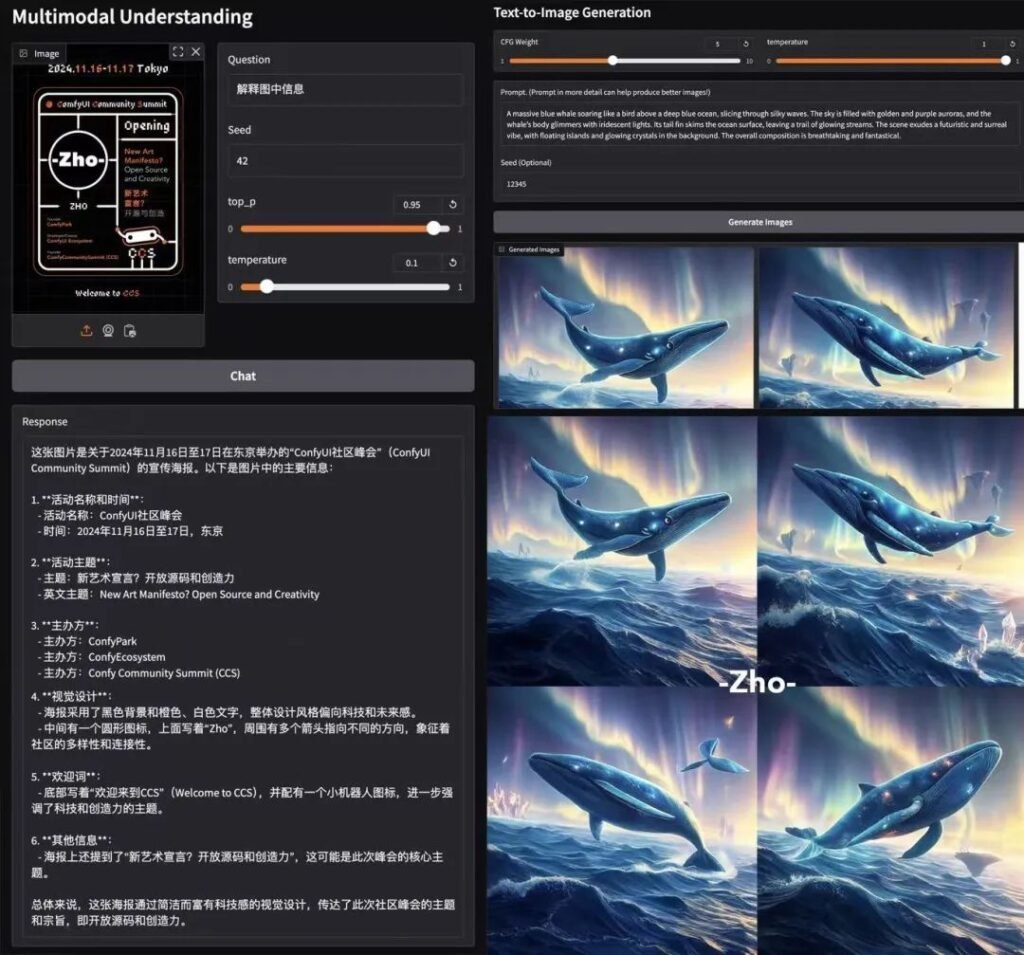

Valós-világ tesztelés

- Sebesség: ~(L4 GPU, 22 GB VRAM).

- Minőség: Erős prompt betartás, bár kisebb részleteken még finomítani kell.

- Colab Demo: Próbálja ki az Janus-Pro-7B-t (Pro szint szükséges).

Műszaki lebontás

Építészet

- Az útvonal megértése: Tiszta kép → SigLIP-L kódoló → LLM → szöveges válasz.

- Generációs útvonal: Zajos kép → egyenesített áramlás dekóder + LLM → Iteratív zajmentesítés.

Kulcsfontosságú innovációk

- Leválasztott vizuális kódolás: A látásmodulokban a "szerepkonfliktus" megelőzése a megértés/generálás külön útjain.

- Megosztott transzformátor mag: Lehetővé teszi a feladatok közötti tudásátadást (pl. a "macska" fogalmak megtanulása segíti a felismerést és a rajzolást is).

Közösségi Buzz

AK (AI kutató): "Az Janus-Pro egyszerűsége és rugalmassága miatt kiválóan alkalmas a következő generációs multimodális rendszerekhez. A látási útvonalak szétválasztásával, miközben megtartja az egységes transzformátort, egyensúlyt teremt a specializáció és az általánosítás között - ami ritka teljesítmény."

Miért fontos az MIT licenc

- Szabadság: Használja, módosítsa és terjessze kereskedelmi célokra minimális korlátozásokkal.

- Átláthatóság: A teljes kódhoz való hozzáférés felgyorsítja a közösség által vezérelt fejlesztéseket.

Final Take

A DeepSeek Janus-Pro nem csak egy újabb mesterséges intelligencia modell - paradigmaváltás. Azáltal, hogy a megértést és a generálást egy fedél alatt egyesíti, megnyitja az ajtókat az intelligensebb kreatív eszközök, a valós idejű alkalmazások és a költséghatékony telepítések előtt. Nyílt forráskódú hozzáféréssel és MIT licenceléssel ez lehet a multimodális innováció következő hullámának katalizátora. 🚀

Fejlesztőknek: Nézze meg a ComfyUI csomópontok és csatlakozz a kísérletezési hullámhoz!

ezt a bejegyzést szponzorálja: