И эра искусственного интеллекта тихо наступила.

Наверное, никто не ожидал, что в этот китайский Новый год самой горячей темой станет уже не традиционная для интернета битва за красный конверт, который стал партнером Spring Festival Gala, а компании искусственного интеллекта.

С приближением Весеннего фестиваля крупные модельные компании не расслаблялись, обновляя целую волну моделей и продуктов. Однако больше всего говорили о DeepSeek, "крупной модельной компании", появившейся в прошлом году.

Вечером 20 января, ГлубокийSeek выпустила официальную версию своей модели рассуждений DeepSeek-R1. Используя низкие затраты на обучение, она напрямую обучила человека, не уступая в производительности модели рассуждений OpenAI o1. Более того, она полностью бесплатна и имеет открытый исходный код, что сразу же вызвало землетрясение в индустрии.

Это первый случай, когда отечественный ИИ вызвал ажиотаж в мире технологий в широких масштабах по всему миру, особенно в Соединенных Штатах. Разработчики заявили, что рассматривают возможность использования DeepSeek для "перестройки всего". На волне этой волны, после недельного брожения и даже только что выпущенного в январе мобильного приложения DeepSeek, оно быстро достигло вершины рейтинга бесплатных приложений в Apple App Store в США, обогнав не только ChatGPT, но и другие популярные в США приложения.

Успех DeepSeek даже напрямую повлиял на фондовый рынок США. Модель, обученная без использования огромного количества дорогостоящих графических процессоров, заставила людей пересмотреть подход к обучению искусственного интеллекта, что привело к сильнейшему падению акций первой компании, создавшей ИИ, NVIDIA, на 17%.

И это еще не все.

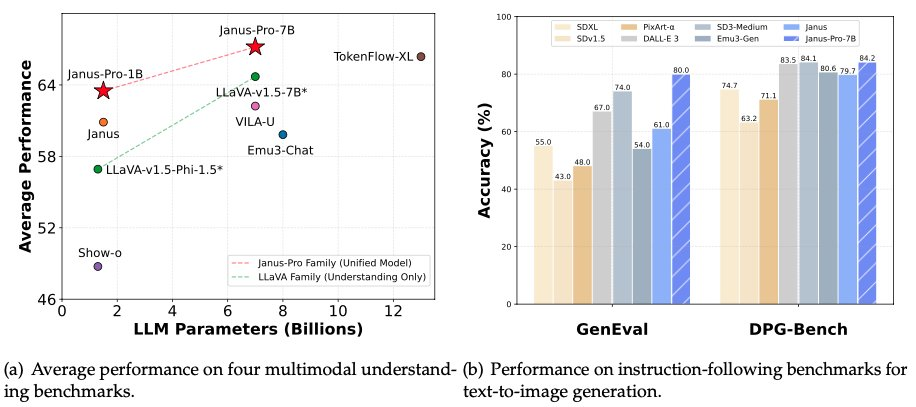

Ранним утром 28 января, в ночь перед Новым годом, компания DeepSeek в очередной раз открыла исходный код своей мультимодальной модели Janus-Pro-7B, объявив, что она победила DALL-E 3 (от OpenAI) и Stable Diffusion в бенчмарк-тестах GenEval и DPG-Bench.

Действительно ли DeepSeek собирается захватить сообщество ИИ? От моделей вывода до мультимодальных моделей - перестроит ли DeepSeek все, что станет первой темой Года Змеи?

Janus ProПроверка инновационной архитектуры мультимодальной модели

На этот раз DeepSeek поздно вечером выпустила в общей сложности две модели: Janus-Pro-7B и Janus-Pro-1B (параметры 1,5B).

Как следует из названия, сама модель является усовершенствованной по сравнению с предыдущей моделью Janus.

Компания DeepSeek впервые выпустила модель Janus только в октябре 2024 года. Как обычно у DeepSeek, модель использует инновационную архитектуру. Во многих моделях генерации видения используется единая архитектура трансформатора, который может одновременно обрабатывать задачи преобразования текста в изображение и изображения в текст.

DeepSeek предлагает новую идею, разделяя визуальное кодирование задач понимания (граф-текст) и генерации (текст-граф), что повышает гибкость обучения модели и эффективно устраняет конфликты и узкие места в производительности, вызванные использованием одного визуального кодирования.

Именно поэтому DeepSeek назвала модель Janus. Янус - древнеримский бог дверей, который изображается с двумя лицами, обращенными в противоположные стороны. По словам DeepSeek, модель названа "Янус", потому что она может смотреть на визуальные данные разными глазами, кодировать признаки по отдельности, а затем использовать один и тот же орган (трансформер) для обработки этих входных сигналов.

Эта новая идея дала хорошие результаты в серии моделей Janus. Команда говорит, что модель Janus обладает сильными возможностями следования командам, многоязычными возможностями и более умной моделью, способной читать изображения мемов. Она также может решать такие задачи, как преобразование латексных формул и преобразование графиков в код.

В серии моделей Janus Pro команда частично изменила процесс обучения модели, что позволило добиться результатов, превосходящих DALL-E 3 и Stable Diffusion в бенчмарках GenEval и DPG-Bench.

Вместе с самой моделью DeepSeek также выпустила новый фреймворк мультимодального ИИ Janus Flow, который призван унифицировать задачи понимания и генерации изображений.

Модель Janus Pro может обеспечить более стабильный результат при использовании коротких подсказок, с лучшим визуальным качеством, более богатой детализацией и возможностью генерировать простой текст.

Модель может генерировать изображения и описывать картинки, определять достопримечательности (например, Западное озеро в Ханчжоу), распознавать текст на изображениях и описывать знания на картинках (например, пирожные "Том и Джерри").

One x.com, Многие уже начали экспериментировать с новой моделью.

Тест на распознавание изображений показан слева на рисунке выше, а тест на генерацию изображений - справа.

Как видно, Janus Pro также отлично справляется с чтением изображений с высокой точностью. Он может распознавать смешанный набор математических выражений и текста. В будущем, возможно, будет более важным использовать его с моделью рассуждений.

Параметры 1B и 7B могут открыть новые сценарии применения

В задачах мультимодального понимания новая модель Janus-Pro использует SigLIP-L в качестве визуального кодера и поддерживает входные изображения размером 384 x 384 пикселя. В задачах генерации изображений Janus-Pro использует токенизатор из определенного источника с частотой понижения дискретизации 16.

Это все еще относительно небольшой размер изображения. X По мнению пользователей, модель Janus Pro - это скорее направленная проверка. Если проверка окажется надежной, будет выпущена модель, которую можно будет запустить в производство.

Однако стоит отметить, что новая модель, выпущенная компанией Janus на этот раз, является не только архитектурной инновацией для мультимодальных моделей, но и новым достижением в плане количества параметров.

Модель, с которой DeepSeek Janus Pro сравнивает в этот раз, DALL-E 3, ранее заявляла, что имеет 12 миллиардов параметров, в то время как крупногабаритная модель Janus Pro имеет только 7 миллиардов параметров. При таких компактных размерах уже очень хорошо, что Janus Pro может достичь таких результатов.

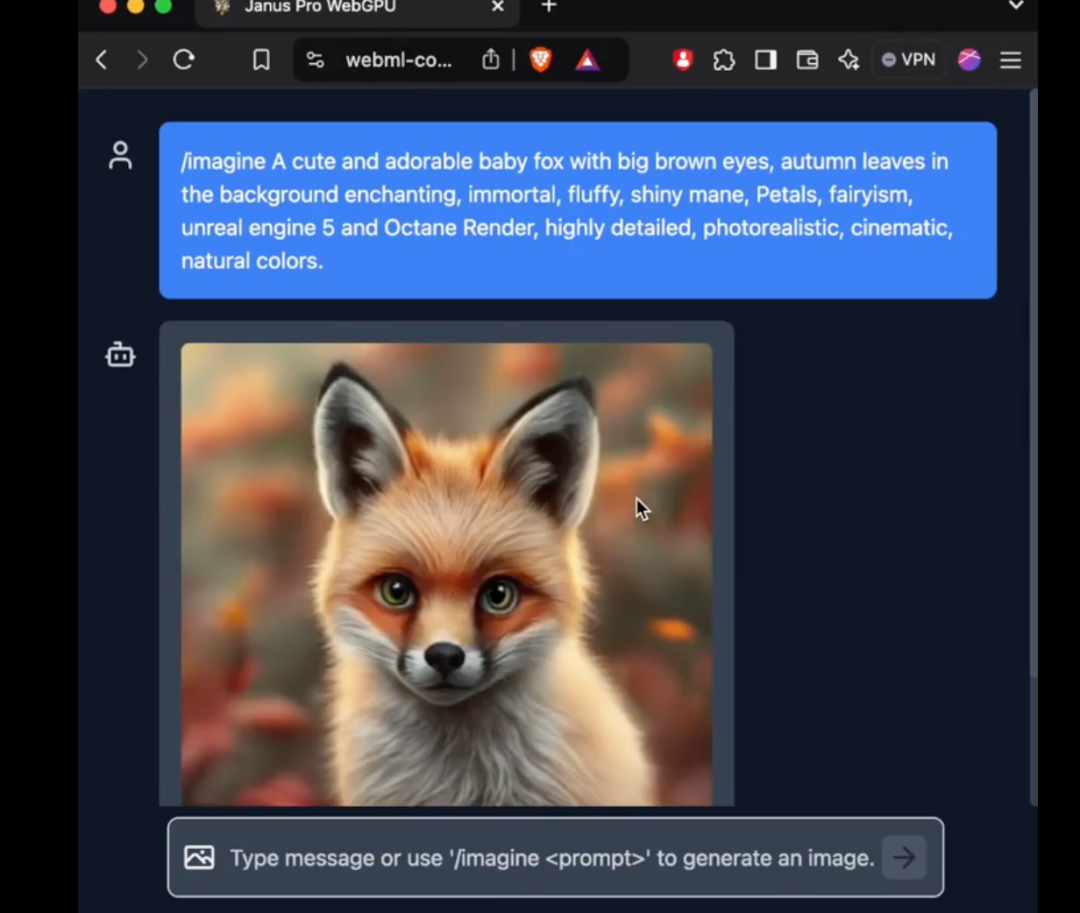

В частности, модель 1B Janus Pro использует всего 1,5 миллиарда параметров. Пользователи уже добавили поддержку модели в transformers.js во внешней сети. Это означает, что теперь модель 100% можно запускать в браузерах на WebGPU!

Хотя на момент публикации статьи автору еще не удалось успешно использовать новую модель Janus Pro в веб-версии, тот факт, что количество параметров достаточно мало для запуска непосредственно в веб-версии, все равно является потрясающим улучшением.

Это означает, что стоимость создания изображений и их понимания продолжает снижаться. У нас есть возможность увидеть использование искусственного интеллекта во многих местах, где раньше нельзя было использовать необработанные изображения и понимание изображений, что изменит нашу жизнь.

Главной темой 2024 года станет то, как аппаратные средства ИИ с дополнительным мультимодальным пониманием смогут вмешиваться в нашу жизнь. Модели мультимодального понимания со все более низкими параметрами или модели, которые, как можно ожидать, будут работать на грани, могут обеспечить дальнейший рост аппаратных средств ИИ.

DeepSeek всколыхнул новый год. Можно ли все переделать с помощью китайского ИИ?

Мир искусственного интеллекта меняется с каждым днем.

В прошлом году во время Весеннего фестиваля мир взбудоражила модель Sora от OpenAI. Однако в течение года китайские компании полностью догнали OpenAI по производству видео, поэтому выход Sora в конце года кажется немного мрачным.

В этом году то, что взбудоражило мир, - это китайский DeepSeek.

DeepSeek не является традиционной технологической компанией, но она создала чрезвычайно инновационные модели по цене намного ниже, чем стоимость GPU-карт крупных американских компаний, что прямо шокировало американских коллег. Американцы воскликнули: "Обучение модели R1 обошлось всего в 5,6 миллиона долларов США, что даже эквивалентно зарплате любого руководителя в команде Meta GenAI. Что же это за таинственная восточная сила?"

Пародийный аккаунт, имитирующий основателя DeepSeek Лианга Вэньфэна, разместил интересную фотографию прямо на X:

На картинке использован модный мем о всемирно известном турецком стрелке в 2024 году.

В финале соревнований по стрельбе из пневматического пистолета с 10 метров на Олимпийских играх в Париже 51-летний турецкий стрелок Митхат Дикеч, на котором были только обычные очки для близоруких и пара берушей для сна, спокойно взял серебряную медаль, держа в кармане одну руку. Всем остальным стрелкам для начала соревнований понадобились две профессиональные линзы для фокусировки и блокировки света, а также пара шумоподавляющих берушей.

С тех пор как DeepSeek "взломал" Модель рассуждений OpenAI, крупнейшие технологические компании США оказались под сильным давлением. Сегодня Сэм Альтман наконец-то выступил с официальным заявлением.

Станет ли 2025 год годом, когда китайский ИИ повлияет на восприятие американцев?

У DeepSeek еще есть несколько секретов в рукаве - это должен быть необычный весенний фестиваль.