DeepSeek web sitesini güncelledi.

Yılbaşı gecesinin erken saatlerinde DeepSeek aniden GitHub'da Janus proje alanının Janus-Pro modeli ve teknik raporunun kaynağını açtığını duyurdu.

Öncelikle, birkaç kilit noktanın altını çizelim:

- Bu Janus-Pro modeli bu kez piyasaya sürülen çok modlu bir modeldir. çok modlu anlama ve görüntü oluşturma görevlerini aynı anda gerçekleştirebilir. Toplam iki parametre versiyonuna sahiptir, Janus-Pro-1B ve Janus-Pro-7B.

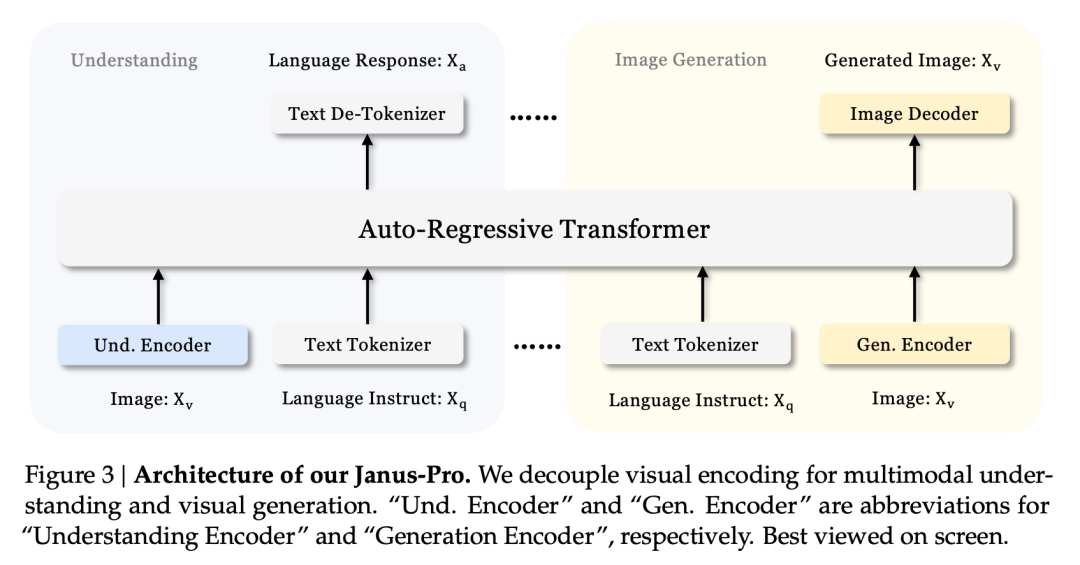

- Janus-Pro'nin temel yeniliği, aşağıdakileri birbirinden ayırmaktır iki farklı görev olan çok modlu anlama ve üretme. Bu, bu iki görevin aynı modelde verimli bir şekilde tamamlanmasına olanak tanır.

- Janus-Pro, DeepSeek tarafından geçen Ekim ayında piyasaya sürülen Janus model mimarisiyle uyumludur, ancak o zaman Janus'un fazla hacmi yoktu. Görme alanında bir algoritma uzmanı olan Dr. Charles bize önceki Janus'un "ortalama" olduğunu ve "DeepSeek'in dil modeli kadar iyi olmadığını" söyledi.

Sektörün zor sorununu çözmeyi amaçlamaktadır: çok modlu anlama ve görüntü oluşturmayı dengelemek

DeepSeek'in resmi tanıtımına göre, Janus-Pro sadece resimleri anlamak, resimlerdeki metni çıkarmak ve anlamakla kalmaz, aynı zamanda resimler de üretebilir.

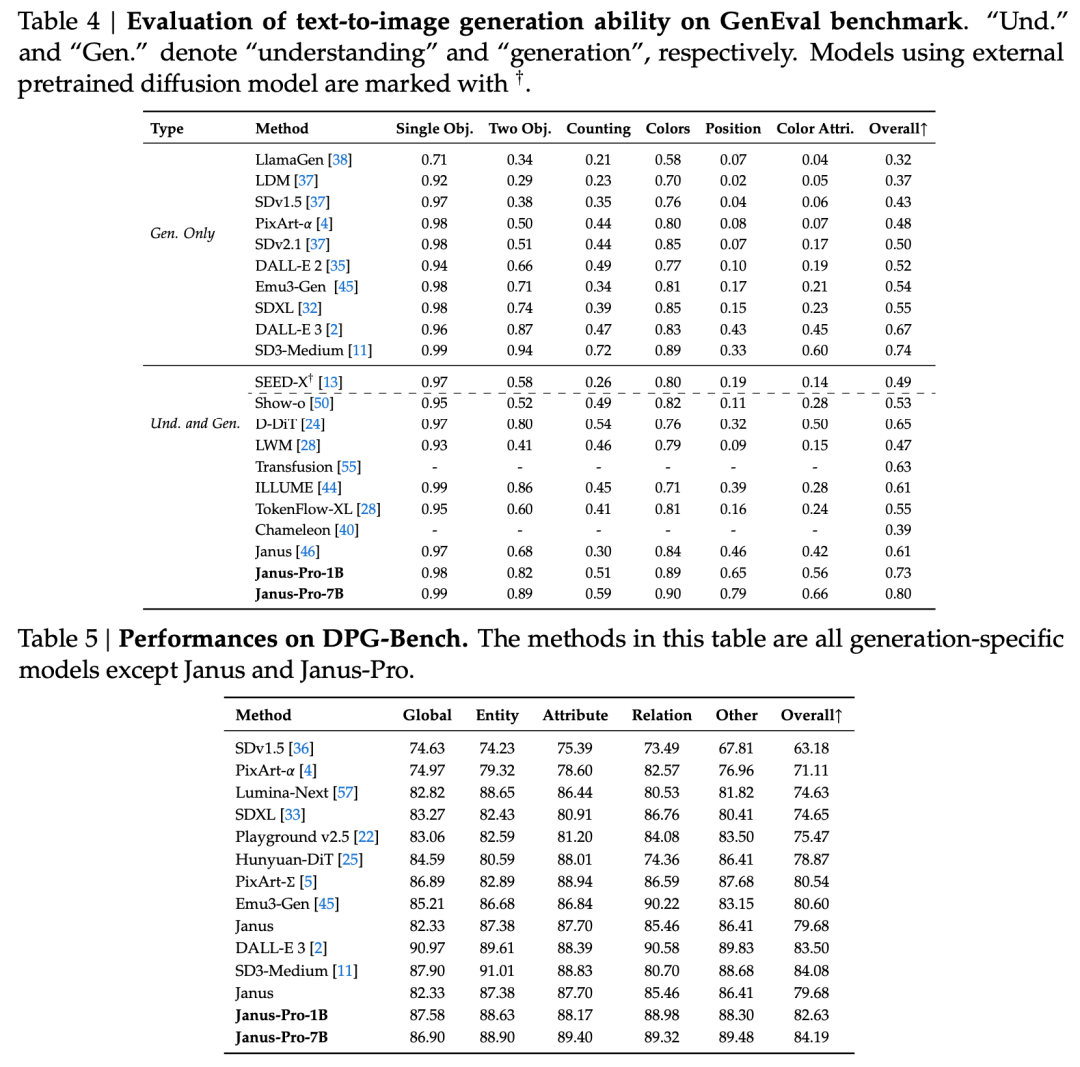

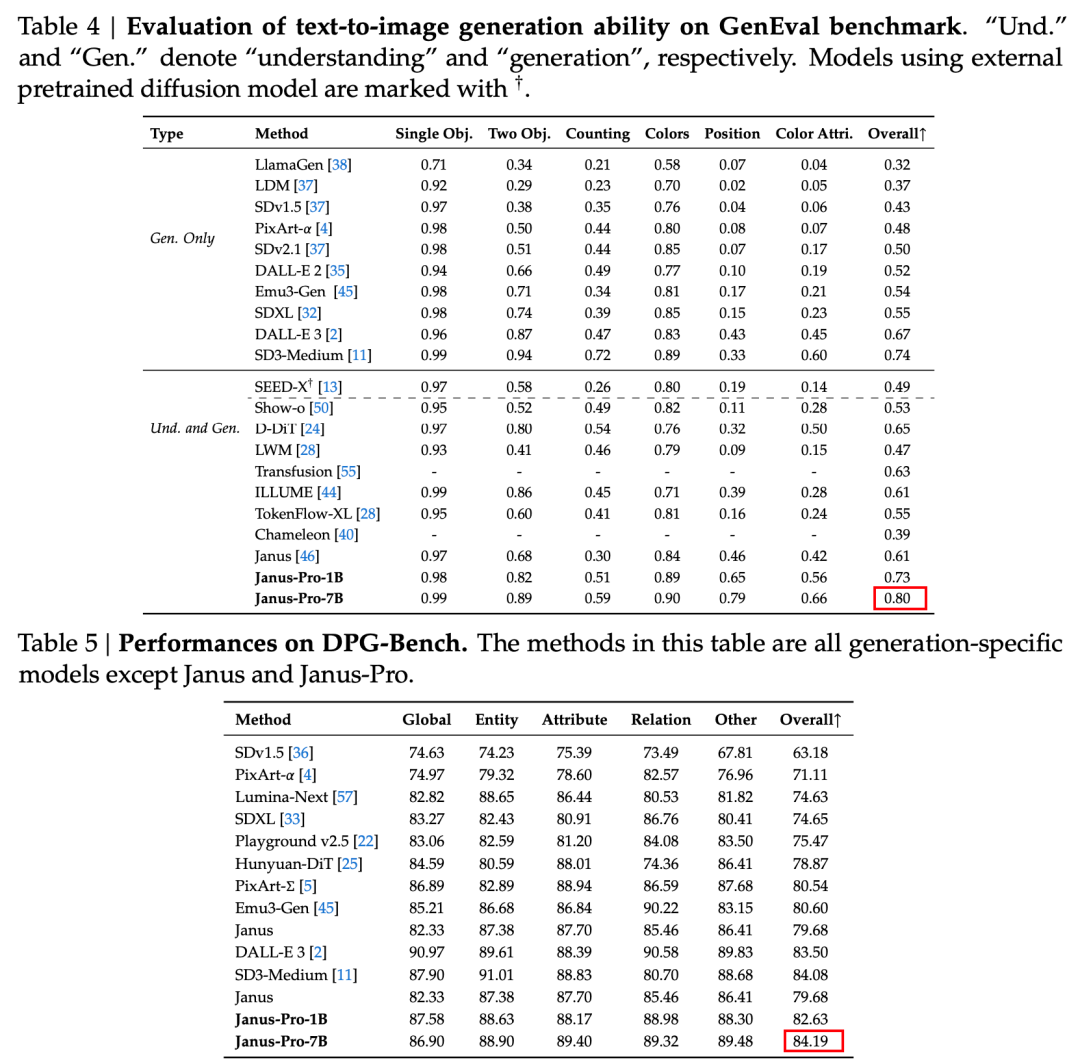

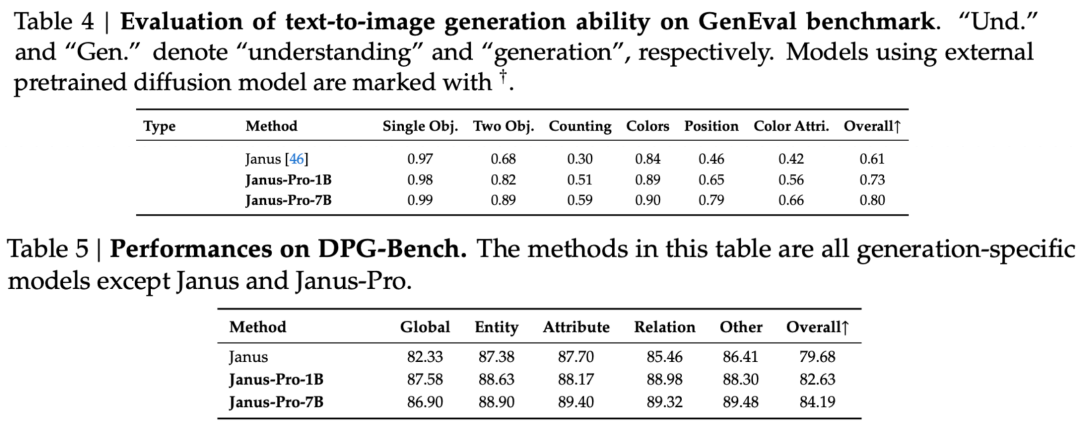

Teknik raporda, aynı tür ve büyüklükteki diğer modellerle karşılaştırıldığında, Janus-Pro-7B'nin GenEval ve DPG-Bench test setlerindeki puanlarının SD3-Medium ve DALL-E 3 gibi diğer modellerden daha yüksektir.

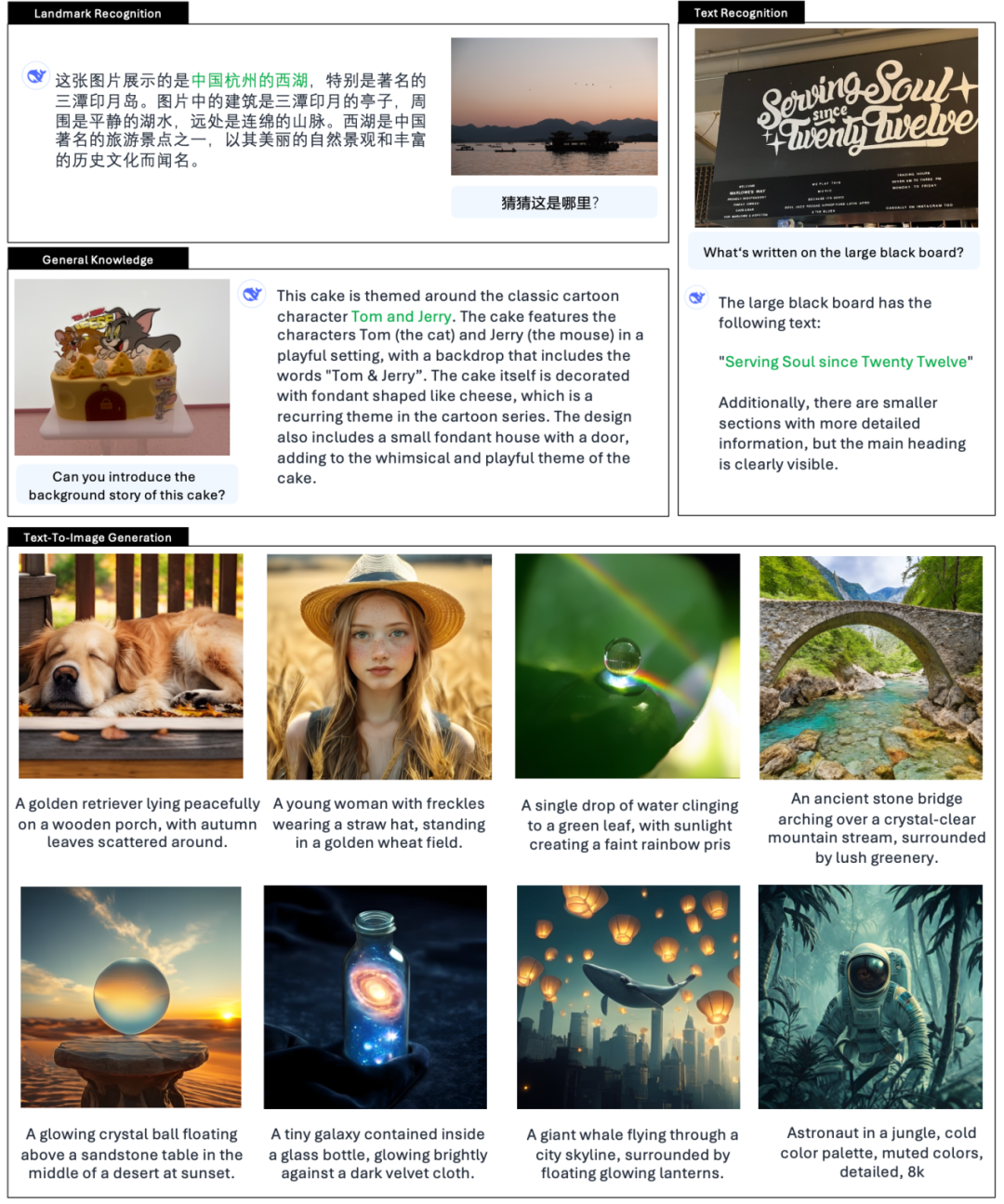

Yetkili ayrıca örnekler de veriyor 👇:

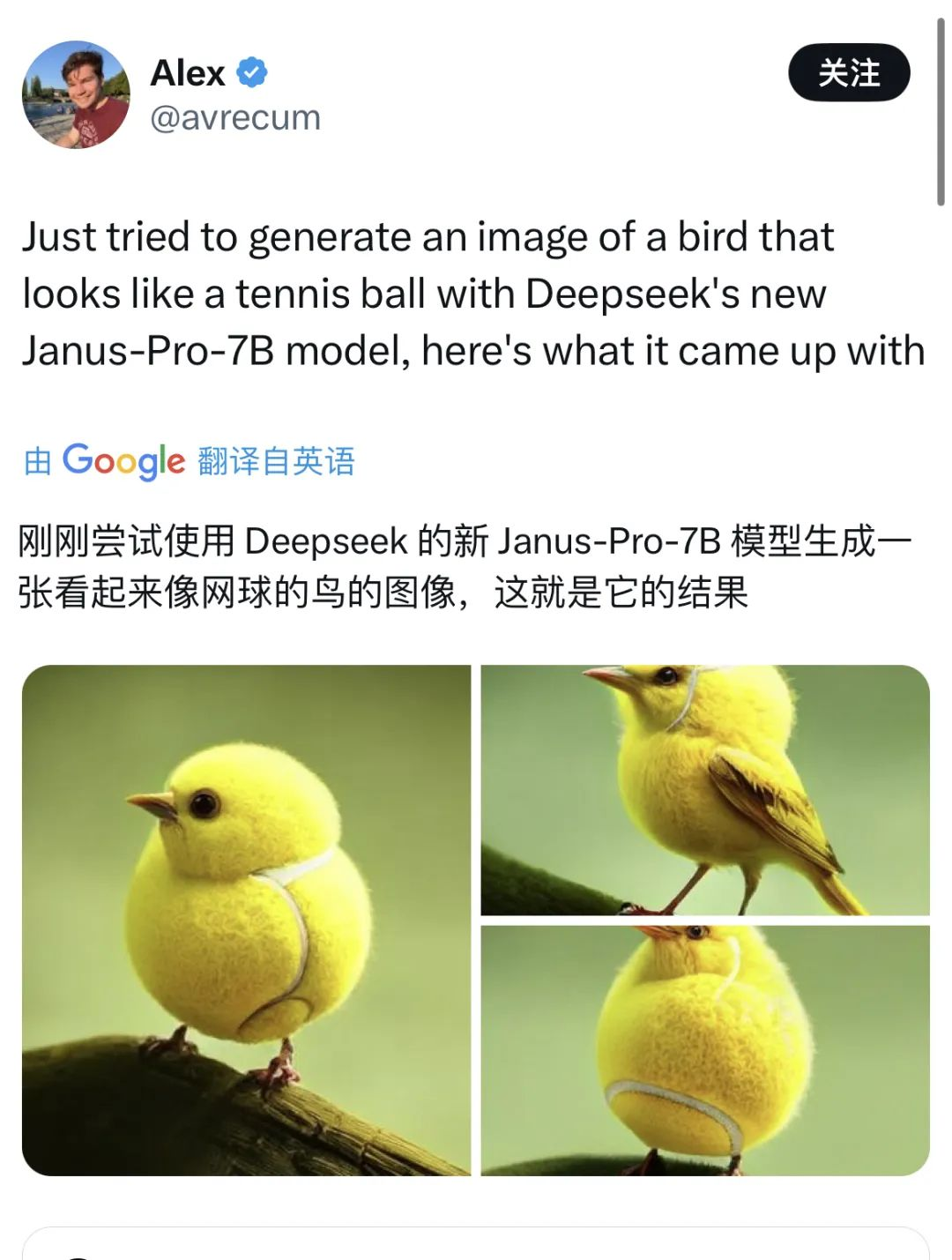

X'te yeni özellikleri deneyen çok sayıda netizen de var.

Ancak ara sıra çökmeler de oluyor.

Teknik dokümanlara başvurarak DeepSeekJanus Pro'nin üç ay önce piyasaya sürülen Janus'a dayalı bir optimizasyon olduğunu tespit ettik.

Bu model serisinin temel yeniliği şudur Görsel anlama görevlerini görsel üretim görevlerinden ayırın, böylece iki görevin etkileri dengelenebilir.

Bir modelin aynı anda çok modlu anlama ve üretim gerçekleştirmesi nadir değildir. Bu test setindeki D-DiT ve TokenFlow-XL bu yeteneğe sahiptir.

Bununla birlikte, Janus'un karakteristik özelliği şudur İşlemeyi ayrıştırarak, çok modlu anlama ve üretme yapabilen bir model, iki görevin etkinliğini dengeler.

İki görevin etkinliğini dengelemek sektörde zor bir sorundur. Önceden, çok modlu anlama ve üretimi mümkün olduğunca uygulamak için aynı kodlayıcıyı kullanma düşüncesi vardı.

Bu yaklaşımın avantajları basit bir mimari, gereksiz dağıtım olmaması ve metin modelleriyle (metin oluşturma ve metin anlama için aynı yöntemleri kullanan) uyumlu olmasıdır. Bir başka argüman da, çoklu yeteneklerin bu şekilde bir araya getirilmesinin belirli bir derecede ortaya çıkmaya yol açabileceğidir.

Bununla birlikte, aslında, üretim ve anlamayı birleştirdikten sonra, iki görev çatışacaktır - görüntü anlama, modelin yüksek boyutlarda soyutlama yapmasını ve makroskopik olana eğilimli olan resmin temel anlamını çıkarmasını gerektirir. Öte yandan görüntü üretimi, piksel düzeyinde yerel ayrıntıların ifade edilmesi ve üretilmesine odaklanır.

Sektörün olağan uygulaması, görüntü oluşturma yeteneklerine öncelik vermektir. Bu da çok modlu modellerle sonuçlanır daha yüksek kaliteli görüntüler üretebilir, ancak görüntü anlama sonuçları genellikle vasattır.

Janus'un ayrıştırılmış mimarisi ve Janus-Pro'nin optimize edilmiş eğitim stratejisi

Janus'un ayrıştırılmış mimarisi, modelin anlama ve üretme görevlerini kendi başına dengelemesini sağlar.

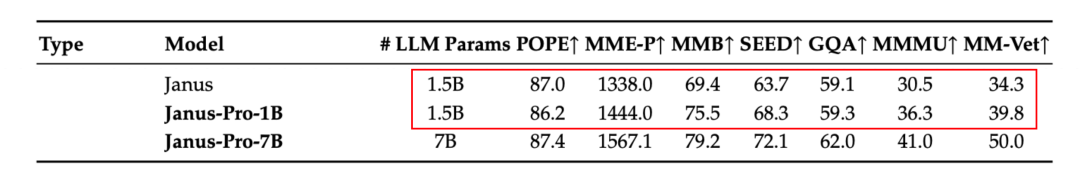

Resmi teknik raporda yer alan sonuçlara göre, ister çok modlu anlama ister görüntü oluşturma olsun, Janus-Pro-7B birden fazla test setinde iyi performans gösteriyor.

Çok modlu anlayış için, Janus-Pro-7B yedi değerlendirme veri setinin dördünde birinci, kalan üçünde ise en üst sıradaki modelin biraz gerisinde kalarak ikinci olmuştur.

Görüntü oluşturma için, Janus-Pro-7B, hem GenEval hem de DPG-Bench değerlendirme veri kümelerinde genel puanlamada birinciliği elde etti.

Bu çoklu görev etkisi temel olarak Janus serisinin farklı görevler için iki görsel kodlayıcı kullanmasından kaynaklanmaktadır:

- Kodlayıcıyı anlama: görüntü anlama görevleri (görüntü soruları ve cevapları, görsel sınıflandırma vb.) için görüntülerdeki anlamsal özellikleri çıkarmak için kullanılır.

- Üretken kodlayıcı: Metin-görüntü oluşturma görevleri için görüntüleri ayrık bir gösterime dönüştürür (örneğin, bir VQ kodlayıcı kullanarak).

Bu mimari ile, Model, her bir kodlayıcının performansını bağımsız olarak optimize edebilir, böylece çok modlu anlama ve üretme görevlerinin her biri en iyi performansa ulaşabilir.

Bu ayrıştırılmış mimari Janus-Pro ve Janus için ortaktır. Peki, Janus-Pro geçtiğimiz birkaç ay içinde hangi yinelemeleri yaptı?

Değerlendirme setinin sonuçlarından görülebileceği gibi, Janus-Pro-1B'nin mevcut sürümü, önceki Janus'a kıyasla farklı değerlendirme setlerinin puanlarında yaklaşık 10% ila 20%'lik bir iyileşmeye sahiptir. Janus-Pro-7B, parametre sayısını genişlettikten sonra Janus'a kıyasla yaklaşık 45%'lik en yüksek iyileşmeye sahiptir.

Eğitim detayları açısından, teknik raporda, Janus-Pro'nin mevcut sürümünün, önceki Janus modeline kıyasla, temel ayrıştırılmış mimari tasarımını koruduğu ve ek olarak aşağıdakileri yinelediği belirtilmektedir parametre boyutu, eğitim stratejisi ve eğitim verileri.

İlk olarak, parametrelere bakalım.

Janus'un ilk sürümünde sadece 1.3B parametre vardı ve Pro'nun mevcut sürümü 1B ve 7B parametreli modeller içeriyor.

Bu iki boyut Janus mimarisinin ölçeklenebilirliğini yansıtmaktadır. En hafif olan 1B modeli, WebGPU kullanılarak tarayıcıda çalıştırılmak üzere harici kullanıcılar tarafından zaten kullanılmıştır.

Ayrıca ve eğitim stratejisi.

Janus'un eğitim aşaması bölümlemesine uygun olarak, Janus Pro toplam üç eğitim aşamasına sahiptir ve makale bunları doğrudan Aşama I, Aşama II ve Aşama III olarak ayırmaktadır.

Her bir aşamanın temel eğitim fikirleri ve eğitim hedefleri korunurken, Janus-Pro üç aşamadaki eğitim süresi ve eğitim verilerinde iyileştirmeler yapmıştır. Aşağıda üç aşamadaki spesifik iyileştirmeler yer almaktadır:

Aşama I - Daha uzun eğitim süresi

Janus ile karşılaştırıldığında Janus-Pro, özellikle görsel kısımdaki adaptörlerin ve görüntü başlıklarının eğitiminde Aşama I'deki eğitim süresini uzatmıştır. Bu, görsel özelliklerin öğrenilmesine daha fazla eğitim süresi verildiği anlamına gelir ve modelin görüntülerin ayrıntılı özelliklerini (piksel-anlamsal eşleme gibi) tam olarak anlayabileceği umulmaktadır.

Bu genişletilmiş eğitim, görsel bölümün eğitiminin diğer modüller tarafından bozulmamasını sağlamaya yardımcı olur.

Aşama II - ImageNet verilerinin kaldırılması ve çok modlu verilerin eklenmesi

Aşama II'de Janus daha önce PixArt'a başvurmuş ve iki bölüm halinde eğitilmiştir. İlk bölüm görüntü sınıflandırma görevi için ImageNet veri kümesi kullanılarak eğitildi ve ikinci bölüm normal metinden görüntüye veriler kullanılarak eğitildi. Aşama II'deki zamanın yaklaşık üçte ikisi ilk kısımda eğitime harcanmıştır.

Janus-Pro, Aşama II'deki ImageNet eğitimini kaldırır. Bu tasarım, modelin Aşama II eğitimi sırasında metinden görüntüye verilere odaklanmasını sağlar. Deneysel sonuçlara göre bu, metinden görüntüye verilerin kullanımını önemli ölçüde artırabilir.

Eğitim yöntemi tasarımının ayarlanmasına ek olarak, Aşama II'de kullanılan eğitim veri seti artık tek bir görüntü sınıflandırma göreviyle sınırlı değildir, aynı zamanda ortak eğitim için görüntü açıklaması ve diyalog gibi diğer çok modlu veri türlerini de içerir.

Aşama III - Veri oranının optimize edilmesi

Aşama III eğitiminde, Janus-Pro farklı eğitim verisi türlerinin oranını ayarlar.

Daha önce, Janus tarafından Aşama III'te kullanılan eğitim verilerindeki çok modlu anlama verileri, düz metin verileri ve metin-imaj verilerinin oranı 7:3:10 idi. Janus-Pro, son iki veri türünün oranını azaltır ve üç veri türünün oranını 5:1:4 olarak ayarlar, yani çok modlu anlama görevine daha fazla önem verir.

Eğitim verilerine bakalım.

Janus ile karşılaştırıldığında, Janus-Pro bu kez yüksek kaliteli sentetik veri.

Çok modlu anlama ve görüntü oluşturma için eğitim verilerinin miktarını ve çeşitliliğini artırır.

Çok modlu anlama verilerinin genişletilmesi:

Janus-Pro, eğitim sırasında DeepSeek-VL2 veri kümesine başvurur ve yalnızca görüntü açıklama veri kümelerini değil, aynı zamanda tablolar, grafikler ve belgeler gibi karmaşık sahnelerin veri kümelerini de içeren yaklaşık 90 milyon ek veri noktası ekler.

Denetimli ince ayar aşaması sırasında (Aşama III), MEME anlayışı ve diyalog (Çince diyalog dahil) deneyimi iyileştirme ile ilgili veri kümeleri eklemeye devam eder.

Görsel üretim verilerinin genişletilmesi:

Orijinal gerçek dünya verilerinin kalitesi düşük ve gürültü seviyeleri yüksekti, bu da modelin kararsız çıktılar ve metinden görüntüye görevlerinde yetersiz estetik kalitede görüntüler üretmesine neden oldu.

Janus-Pro, eğitim aşamasına yaklaşık 72 milyon yeni yüksek estetikli sentetik veri ekleyerek ön eğitim aşamasındaki gerçek verilerin sentetik verilere oranını 1:1'e getirmiştir.

Sentetik verilere ilişkin istemlerin tümü kamu kaynaklarından alınmıştır. Deneyler, bu verilerin eklenmesinin modelin daha hızlı yakınsamasını sağladığını ve üretilen görüntülerin kararlılık ve görsel güzellik açısından belirgin iyileştirmelere sahip olduğunu göstermiştir.

Bir verimlilik devriminin devamı mı?

Genel olarak, bu sürümle DeepSeek görsel modellere verimlilik devrimini getirmiştir.

Tek bir işleve odaklanan görsel modellerin veya belirli bir görevi tercih eden çok modlu modellerin aksine, Janus-Pro görüntü oluşturma ve çok modlu anlama gibi iki ana görevin etkilerini aynı modelde dengeler.

Ayrıca, küçük parametrelerine rağmen, değerlendirmedeOpenAI DALL-E 3 ve SD3-Medium'u geride bıraktı.

Yere kadar genişletildiğinde, işletmenin yalnızca görüntü oluşturma ve anlamanın iki işlevini doğrudan uygulamak için bir model dağıtması gerekir. Sadece 7B'lık bir boyutla birleştiğinde, dağıtım zorluğu ve maliyeti çok daha düşüktür.

R1 ve V3'ün önceki sürümleriyle bağlantılı olarak DeepSeek, oyunun mevcut kurallarına şu şekilde meydan okuyor "kompakt mimari yenilik, hafif modeller, açık kaynak modeller ve ultra düşük eğitim maliyetleri". Batılı teknoloji devleri ve hatta Wall Street arasındaki paniğin nedeni budur.

Birkaç gündür kamuoyunu peşinden sürükleyen Sam Altman, nihayet X'teki DeepSeek ile ilgili bilgilere olumlu yanıt verdi - R1'i överken, OpenAI'nin bazı duyurular yapacağını söyledi.